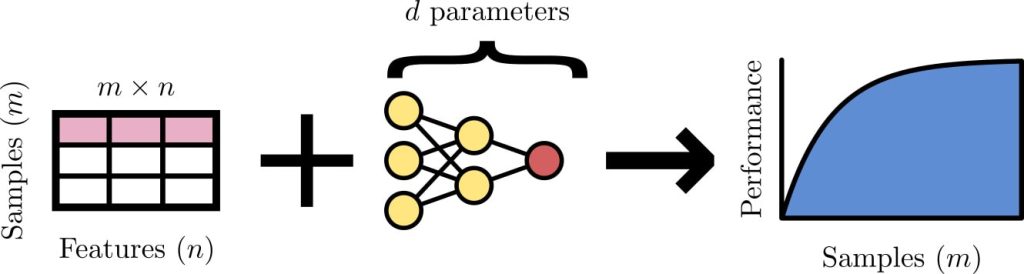

قانون dump به این ایده اشاره دارد که در یادگیری ماشینی، داده های بیشتر اغلب بهتر است. هر چه داده های ما بیشتر باشد، مدل های ما می توانند دقیق تر شوند.

درک مبانی قانون Dump در یادگیری ماشینی

تصور کنید که ما می خواهیم مدلی بسازیم که پیش بینی کند آیا مشتری ریزش می کند یا خیر.

Churn به موقعیتی اشاره دارد که در آن مشتری استفاده از یک محصول یا خدمات را متوقف می کند.

برای ساخت این مدل به داده هایی در مورد ویژگی های مختلف مشتری مانند سن، جنسیت، سابقه خرید و غیره نیاز داریم.

حال، اگر ما فقط یک مجموعه داده کوچک با چند صد مشتری داشته باشیم، ممکن است مدل ما خیلی دقیق نباشد.

ممکن است اطلاعات کافی برای شناسایی الگوهایی که منجر به ریزش می شوند را نداشته باشد.

با این حال، اگر مجموعه داده بزرگی با هزاران یا حتی میلیونها مشتری داشته باشیم، مدل ما شانس بیشتری برای پیشبینی دقیق ریزش خواهد داشت.

این به این دلیل است که با داده های بیشتر، مدل ما می تواند الگوها و همبستگی های بیشتری را شناسایی کند.

می تواند از طیف وسیع تری از رفتارهای مشتری درس بگیرد و پیش بینی های دقیق تری انجام دهد.

به عبارت دیگر، قانون dump نشان می دهد که هرچه داده های بیشتری داشته باشیم، مدل های ما می توانند بهتر شوند.

اما این فقط در مورد کمیت داده ها نیست. کیفیت داده ها نیز مهم است.

در یادگیری ماشینی، زباله در، زباله بیرون یک ضرب المثل رایج است.

اگر داده های ما دارای نویز باشد یا دارای خطا باشد، مدل های ما نیز نادرست خواهند بود.

بنابراین، اطمینان از پاک بودن و قابل اعتماد بودن داده هایی که برای آموزش مدل های خود استفاده می کنیم، ضروری است.

جنبه دیگری که باید در نظر گرفت تعادل بین تعداد ویژگی ها و تعداد نمونه ها است.

ویژگی ها به ویژگی ها یا متغیرهایی اشاره دارد که ما برای آموزش مدل های خود استفاده می کنیم.

اگر ویژگیهای بسیار زیاد و نمونههای بسیار کمی داشته باشیم، مدلهای ما ممکن است بیش از حد با دادهها مطابقت داشته باشند.

تطبیق بیش از حد زمانی اتفاق می افتد که یک مدل بیش از حد پیچیده می شود و به جای یادگیری از آن، شروع به حفظ داده های آموزشی می کند.

برای جلوگیری از برازش بیش از حد، می توانیم از تکنیک هایی مانند منظم سازی یا انتخاب ویژگی استفاده کنیم.

منظمسازی یک عبارت جریمه به تابع هدف مدل اضافه میکند و آن را از پیچیده شدن بیش از حد منصرف میکند.

انتخاب ویژگی، از سوی دیگر، شامل انتخاب تنها مرتبط ترین ویژگی ها برای آموزش مدل است.

در نتیجه، قانون dump یک مفهوم اساسی در یادگیری ماشین است.

بر اهمیت داشتن داده های بیشتر برای ساخت مدل های دقیق تاکید می کند.

با داده های بیشتر، مدل های ما می توانند الگوهای بیشتری را شناسایی کرده و پیش بینی های بهتری انجام دهند.

با این حال، اطمینان از کیفیت بالای دادهها و ایجاد تعادل بین تعداد ویژگیها و نمونهها بسیار مهم است.

با درک و اعمال قانون dump، میتوانیم عملکرد مدلهای یادگیری ماشینی خود را بهبود بخشیم و تصمیمات آگاهانهتری بگیریم.

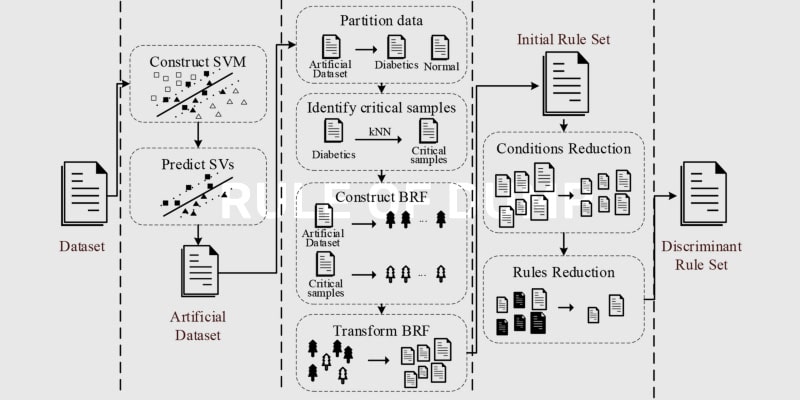

کاوش در نقش قانون Dump در درختان تصمیم گیری

یادگیری ماشینی یک زمینه جذاب است که روش حل مسائل پیچیده را متحول کرده است.

یکی از تکنیک های کلیدی مورد استفاده در یادگیری ماشینی درخت تصمیم است.

درختهای تصمیم مدلهای قدرتمندی هستند که میتوانند هم برای طبقهبندی و هم برای کارهای رگرسیون استفاده شوند.

درک و تفسیر آنها آسان است و آنها را به یک انتخاب محبوب در میان دانشمندان داده تبدیل می کند.

هنگام ساختن یک درخت تصمیم، یک مفهوم مهم که باید در نظر گرفته شود، قانون dump است.

قاعده dump به روند جلوگیری از رشد بیشتر درخت در صورت تحقق یک شرط خاص اشاره دارد.

این شرایط معمولاً بر اساس تعداد نمونه ها در یک گره یا عمق درخت است.

قانون dump به عنوان یک تکنیک منظم عمل می کند و از تطبیق بیش از حد درخت با داده های آموزشی جلوگیری می کند.

تطبیق بیش از حد زمانی اتفاق میافتد که یک مدل دادههای آموزشی را خیلی خوب یاد بگیرد و نتواند به دادههای جدید و نادیده تعمیم یابد.

با جلوگیری از رشد بیش از حد درخت، میتوانیم از برازش بیش از حد جلوگیری کنیم و عملکرد مدل را در دادههای دیده نشده بهبود ببخشیم.

روش های مختلفی برای اجرای قانون dump در درخت های تصمیم وجود دارد.

یکی از رویکردهای رایج، تنظیم حداقل تعداد نمونه مورد نیاز برای تقسیم یک گره است.

اگر یک گره نمونه های کمتری از این آستانه داشته باشد، بیشتر از این تقسیم نمی شود و به یک گره برگ تبدیل می شود.

این تضمین می کند که هر گره برگ حاوی تعداد کافی نمونه برای پیش بینی های قابل اعتماد است.

روش دیگر محدود کردن عمق درخت است.

با تنظیم حداکثر عمق، از بلند شدن بیش از حد درخت و ثبت نویز یا الگوهای نامربوط در داده ها جلوگیری می کنیم.

این به مدل کمک می کند تا بر مهمترین ویژگی ها تمرکز کند و توانایی آن را برای تعمیم بهبود بخشد.

قانون dump را می توان با سایر تکنیک های منظم سازی مانند هرس نیز ترکیب کرد.

هرس شامل حذف شاخه های غیر ضروری از درخت برای ساده سازی ساختار آن است.

این به کاهش پیچیدگی و بهبود قابلیت تفسیر بدون به خطر انداختن عملکرد کمک می کند.

توجه به این نکته مهم است که قانون dump یک راه حل یکسان نیست.

مقادیر بهینه برای حداقل تعداد نمونه و حداکثر عمق ممکن است بسته به مجموعه داده و مشکل موجود متفاوت باشد.

برای یافتن تعادل مناسب بین underfitting و overfitting نیاز به تنظیم و آزمایش دقیق دارد.

علاوه بر جلوگیری از برازش بیش از حد، قانون dump می تواند به بهبود کارایی محاسباتی درختان تصمیم نیز کمک کند.

با محدود کردن عمق یا تعداد نمونه ها در هر گره، تعداد محاسبات مورد نیاز در طول آموزش و پیش بینی را کاهش می دهیم.

این می تواند به ویژه هنگام برخورد با مجموعه داده های بزرگ یا برنامه های بلادرنگ که سرعت در آنها بسیار مهم است مفید باشد.

در نتیجه، قاعده dump با جلوگیری از برازش بیش از حد و بهبود تعمیم، نقش مهمی در درختان تصمیم ایفا می کند.

این به ایجاد تعادل بین پیچیدگی و سادگی کمک میکند و اطمینان میدهد که مدل مهمترین الگوها را در دادهها بدون گم شدن در نویز ثبت میکند.

با تعیین آستانه های مناسب برای حداقل تعداد نمونه و حداکثر عمق، می توانیم درخت های تصمیم گیری درست و کارآمد ایجاد کنیم.

بنابراین، دفعه بعد که در حال ساختن درخت تصمیم هستید، فراموش نکنید که قانون dump را در نظر بگیرید!

مزایا و محدودیتهای Rule of Dump در یادگیری ماشینی

برخلاف سایر الگوریتمهای پیچیده یادگیری ماشین، رویکرد مبتنی بر قانون، قوانین واضح و قابل فهمی را ارائه میکند که میتوانند به راحتی توسط انسان تفسیر شوند.

این باعث می شود که برای برنامه هایی که شفافیت و توضیح پذیری در آنها بسیار مهم است، مانند تشخیص پزشکی یا امتیازدهی اعتبار، انتخاب ایده آلی باشد.

یکی دیگر از مزایای قانون dump سادگی آن است.

ایجاد و حفظ یک سیستم مبتنی بر قانون در مقایسه با سایر تکنیک های یادگیری ماشینی نسبتاً ساده است.

به حداقل منابع محاسباتی نیاز دارد و می توان آن را با استفاده از زبان های برنامه نویسی پایه پیاده سازی کرد.

این سادگی آن را برای طیف وسیعی از کاربران، از جمله کسانی که تخصص فنی محدودی دارند، در دسترس قرار می دهد.

علاوه بر این، قانون dump برای داده های پر سر و صدا یا ناقص قوی است.

الگوریتمهای یادگیری ماشین سنتی اغلب با دادههایی که حاوی مقادیر گمشده یا پرت هستند، دست و پنجه نرم میکنند.

در مقابل، رویکرد مبتنی بر قاعده میتواند چنین دادههایی را با ترکیب قوانینی که این عدم قطعیتها را توضیح میدهند، به طور موثر اداره کند.

این آن را به ابزاری ارزشمند در سناریوهای دنیای واقعی تبدیل می کند که ممکن است کیفیت داده ها به خطر بیفتد.

با این حال، قانون دامپ نیز محدودیت هایی دارد.

یکی از اشکالات اصلی ناتوانی آن در مدیریت روابط پیچیده یا غیرخطی در داده ها است.

رویکرد مبتنی بر قاعده بر عبارات ساده اگر-آنگاه تکیه دارد، که ممکن است پیچیدگی های الگوهای پیچیده را در بر نگیرد.

این می تواند منجر به عملکرد کمتر از حد مطلوب در کارهایی شود که نیاز به مدل سازی پیچیده دارند، مانند تشخیص تصویر یا پردازش زبان طبیعی.

علاوه بر این، قانون dump به شدت به کیفیت قوانین و تخصص طراح قوانین بستگی دارد.

اگر قوانین به خوبی تعریف نشده باشند یا اگر طراح قوانین فاقد دانش دامنه باشد، سیستم ممکن است نتایج نادرست یا غیرقابل اعتمادی ایجاد کند.

این امر اهمیت مشارکت متخصص و مهندسی دقیق قوانین را در رویکرد مبتنی بر قانون نشان میدهد.

یکی دیگر از محدودیت های قاعده dump عدم سازگاری آن است.

زمانی که قوانین تعریف می شوند، ثابت می مانند و به راحتی نمی توان آنها را به روز کرد یا تغییر داد.

این می تواند در محیط های پویا که در آن توزیع داده های اساسی یا الزامات مشکل در طول زمان تغییر می کند، مشکل ساز باشد.

در چنین مواردی، الگوریتمهای یادگیری ماشین سنتی که میتوانند با دادههای جدید سازگار شوند و یاد بگیرند، ممکن است مناسبتر باشند.

در نتیجه، قانون dump یک تکنیک ارزشمند در یادگیری ماشین با مزایا و محدودیتهای آن است.

تفسیرپذیری، سادگی و استحکام آن در برابر داده های پر سر و صدا، آن را به یک انتخاب محبوب در حوزه های مختلف تبدیل کرده است.

با این حال، ناتوانی آن در مدیریت روابط پیچیده و عدم سازگاری، کاربرد آن را در برخی وظایف محدود می کند.

درک این مزایا و معایب در تعیین زمان و نحوه استفاده موثر از قانون تخلیه بسیار مهم است.

اجرای قانون Dump در ماشین الگوریتم های یادگیری

قانون Dump بر این ایده استوار است که یک مجموعه داده بزرگتر نمایش جامع تری از مشکل در دست ارائه می دهد.

اجرای قانون Dump در الگوریتم های یادگیری ماشینی شامل جمع آوری و پیش پردازش حجم زیادی از داده ها است.

داده ها می توانند از منابع مختلفی مانند حسگرها، پایگاه های داده یا حتی پلتفرم های رسانه های اجتماعی به دست آیند.

هنگامی که داده ها جمع آوری می شوند، باید پاک شوند و به قالبی تبدیل شوند که به راحتی توسط الگوریتم قابل درک باشد.

این مرحله پیش پردازش بسیار مهم است زیرا تضمین می کند که داده ها سازگار و عاری از هر گونه خطا یا موارد پرت هستند.

پس از پیش پردازش داده ها، نوبت به آموزش الگوریتم یادگیری ماشین می رسد.

آموزش شامل تغذیه الگوریتم با داده های از پیش پردازش شده و اجازه دادن به آن برای یادگیری از آن است.

الگوریتم الگوها و روابط موجود در داده ها را تجزیه و تحلیل می کند و پارامترهای داخلی خود را بر این اساس تنظیم می کند.

هرچه داده های بیشتری داشته باشید، پیش بینی های الگوریتم دقیق تر و قابل اعتمادتر خواهد بود.

توجه به این نکته مهم است که اجرای قانون Dump به معنای پرتاب کورکورانه داده های بیشتر در الگوریتم نیست.

کیفیت داده ها به اندازه کمیت مهم است.

بسیار مهم است که اطمینان حاصل شود که داده ها با مشکلی که در تلاش برای حل آن هستید مرتبط هستند و طیف وسیعی از سناریوها را پوشش می دهند.

علاوه بر این، داده ها باید معرف شرایط دنیای واقعی باشد که الگوریتم در آن مستقر می شود.

یکی دیگر از جنبه هایی که در اجرای قانون Dump باید در نظر گرفت منابع محاسباتی مورد نیاز است.

پردازش و تجزیه و تحلیل مجموعه داده های بزرگ می تواند از نظر محاسباتی فشرده باشد و ممکن است به سخت افزار قدرتمند یا راه حل های مبتنی بر ابر نیاز داشته باشد.

وجود زیرساخت های لازم برای مدیریت حجم داده های افزایش یافته مهم است.

در نتیجه، قانون Dump یک مفهوم اساسی در یادگیری ماشینی است که بر اهمیت داشتن مجموعه داده بزرگ و متنوع تاکید دارد.

با اجرای این قانون، الگوریتم های یادگیری ماشینی می توانند به دقت و قابلیت اطمینان بالاتری در پیش بینی های خود دست یابند.

با این حال، بسیار مهم است که اطمینان حاصل شود که داده ها با کیفیت بالا و معرف مشکل در دست هستند.

علاوه بر این، منابع محاسباتی مورد نیاز برای مدیریت مجموعه داده های بزرگ باید در نظر گرفته شوند.

با پیروی از این دستورالعملها، میتوانید به طور مؤثر قانون Dump را در الگوریتمهای یادگیری ماشین خود پیادهسازی کنید و عملکرد آنها را بهبود بخشید.

ارزیابی عملکرد قانون Dump در مدل های یادگیری ماشینی

مدلهای یادگیری ماشین سنتی، مانند شبکههای عصبی یا ماشینهای بردار پشتیبان، اغلب مدلهای جعبه سیاه را تولید میکنند که تفسیر آنها دشوار است.

این عدم تفسیرپذیری میتواند مشکلساز باشد، بهویژه در حوزههایی که شفافیت و مسئولیتپذیری بسیار مهم هستند، مانند مراقبتهای بهداشتی یا مالی.

با استفاده از قانون dump، میتوانیم مدلهایی ایجاد کنیم که نه تنها دقیق هستند، بلکه قابل توضیح هستند و بینشهایی را در مورد فرآیند تصمیمگیری ارائه میدهند.

مزیت دیگر قانون dump کارایی محاسباتی آن است.

مدل های پیچیده یادگیری ماشین اغلب به منابع محاسباتی قابل توجهی برای آموزش و پیش بینی نیاز دارند.

در مقابل، مدلهای dump بسیار سادهتر هستند و به منابع کمتری نیاز دارند و در دسترستر و مقرونبهصرفهتر میشوند.

این به ویژه برای برنامه هایی با قدرت محاسباتی محدود، مانند سیستم های جاسازی شده یا دستگاه های تلفن همراه مفید است.

با این حال، توجه به این نکته ضروری است که قاعده dump بدون محدودیت نیست.

یکی از چالش های اصلی یافتن تعادل مناسب بین سادگی و دقت است.

در حالی که قواعد ساده به راحتی قابل درک هستند، ممکن است پیچیدگی داده های زیربنایی را نشان ندهند، که منجر به عملکرد پیش بینی پایین تر می شود.

از سوی دیگر، مدلهای پیچیده ممکن است به دقت بالاتری دست یابند اما به قیمت تفسیرپذیری.

بنابراین، ارزیابی دقیق مبادلات و انتخاب سطح مناسب پیچیدگی برای هر برنامه خاص بسیار مهم است.

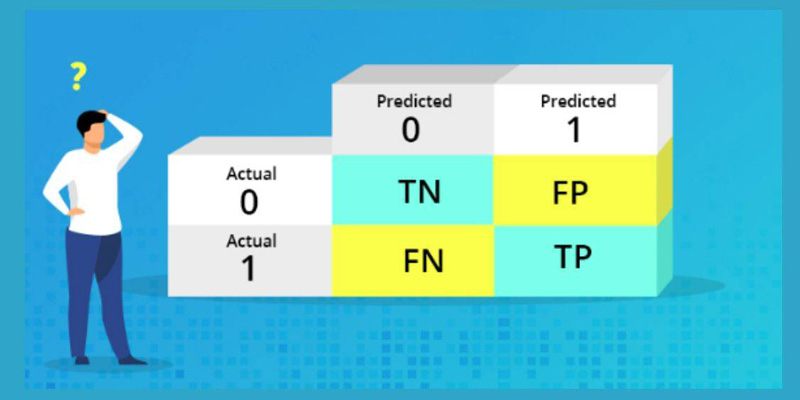

برای ارزیابی عملکرد قانون dump در مدل های یادگیری ماشینی، می توان از معیارهای مختلفی استفاده کرد.

دقت، دقت، یادآوری و امتیاز F1 معمولاً معیارهایی هستند که برای ارزیابی عملکرد پیشبینی مدلها استفاده میشوند.

علاوه بر این، معیارهای تفسیرپذیری، مانند تعداد قوانین یا طول متوسط قوانین، میتوانند برای اندازهگیری سادگی و شفافیت قانون مدلهای dump استفاده شوند.

در نتیجه، قانون dump یک رویکرد ارزشمند در یادگیری ماشین است که هدف آن ایجاد مدلهای ساده و قابل تفسیر است.

با تمرکز بر قوانین ساده، قانون dump شفافیت و مسئولیت پذیری را فراهم می کند و آن را برای برنامه هایی مناسب می کند که درک فرآیند تصمیم گیری در آنها بسیار مهم است.

با این حال، ارزیابی دقیق مبادلات بین سادگی و دقت و انتخاب سطح مناسب پیچیدگی برای هر برنامه خاص مهم است.

با در نظر گرفتن این عوامل و استفاده از معیارهای ارزیابی مناسب، میتوانیم از قدرت قانون dump در مدلهای یادگیری ماشین استفاده کنیم و پتانسیل کامل آن را باز کنیم.

منبع » آکادمی اشکان مستوفی