در این مقاله، چگونگی کاربرد Hanlon’s Razor در زمینه یادگیری ماشین و پیامدهای آن برای توسعه و استقرار سیستمهای هوشمند را بررسی خواهیم کرد.

مقدمه ای بر Hanlon’s Razor در یادگیری ماشین

الگوریتم های یادگیری ماشین برای یادگیری از داده ها و پیش بینی یا تصمیم گیری بر اساس الگوها و مدل های آماری طراحی شده اند.

با این حال، این الگوریتمها خطاناپذیر نیستند و گاهی اوقات میتوانند نتایج غیرمنتظره یا اشتباهی ایجاد کنند.

هنگام مواجهه با چنین موقعیت هایی، ضروری است که این احتمال را در نظر بگیریم که اشتباهات الگوریتم عمدی نیست، بلکه بیشتر ناشی از محدودیت ها یا اشتباهات در داده ها یا خود مدل است.

تیغ هانلون به ما یادآوری میکند که به این موقعیتها با ذهنیتی برخورد کنیم که به جای بدخواهی، بیکفایتی یا نادانی را فرض میکند.

این اصل ما را تشویق میکند تا قبل از نتیجهگیری سریع یا مقصر دانستن، علل اساسی رفتار الگوریتم را بررسی و درک کنیم.

با این کار می توانیم از درگیری های غیر ضروری جلوگیری کرده و بر بهبود عملکرد سیستم تمرکز کنیم.

یکی از سناریوهای رایج که در آن تیغ هانلون وارد عمل می شود، زمانی است که یک الگوریتم یادگیری ماشینی پیش بینی ها یا تصمیمات مغرضانه ای انجام می دهد.

سوگیری میتواند از منابع مختلفی، مانند دادههای آموزشی مغرضانه یا ویژگیهای جانبی مورد استفاده در مدل، ناشی شود.

به جای اینکه فوراً الگوریتم یا توسعه دهندگان آن را به تبعیض عمدی متهم کنیم، Hanlon’s Razor ما را ترغیب می کند که این احتمال را در نظر بگیریم که سوگیری غیرعمدی است و نتیجه نظارت یا عدم آگاهی است.

با اتخاذ این طرز فکر، میتوانیم به تعصب در سیستمهای یادگیری ماشینی بهعنوان مشکلی که باید حل شود، بهجای یک اقدام عمدی تبعیض برخورد کنیم.

ما میتوانیم دادهها و مدلها را بررسی کنیم تا منابع سوگیری را شناسایی کنیم و اقدامات مناسب را برای کاهش یا حذف آن انجام دهیم.

این ممکن است شامل جمعآوری دادههای آموزشی متنوعتر و معرف، استفاده از الگوریتمهای آگاه از انصاف، یا استفاده از تکنیکهای پس از پردازش برای تنظیم پیشبینیها باشد.

حوزه دیگری که Hanlon’s Razor مرتبط است، در تفسیر مدلهای یادگیری ماشین است.

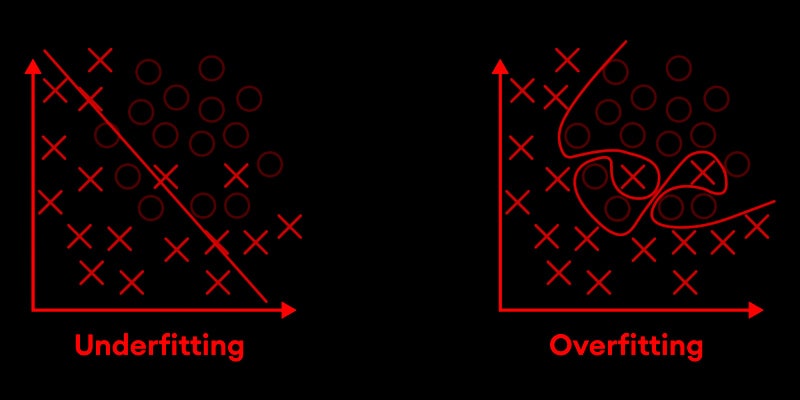

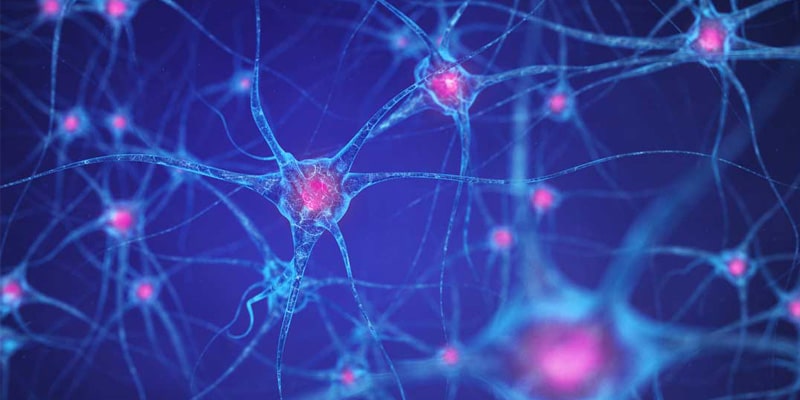

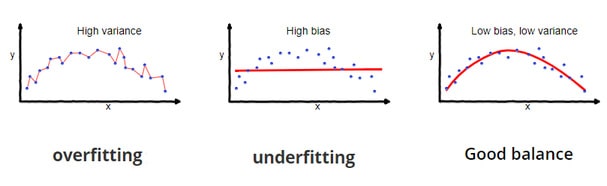

مدلهای پیچیده، مانند شبکههای عصبی عمیق، میتوانند برای تفسیر چالش برانگیز باشند و درک اینکه چرا پیشبینیها یا تصمیمگیریهای خاصی انجام میدهند را دشوار میسازند.

به جای اینکه فرض کنیم مدل به طور عمدی استدلال خود را مبهم می کند، تیغ هانلون ما را تشویق می کند که این احتمال را در نظر بگیریم که عدم تفسیرپذیری به دلیل پیچیدگی ذاتی معماری مدل است.

این دیدگاه به محققان و متخصصان اجازه میدهد تا به جای نسبت دادن قصد بد به مدل، بر توسعه تکنیکها و ابزارهایی برای تفسیرپذیری مدل تمرکز کنند.

با درک اینکه چگونه یک مدل به پیشبینیهای خود میرسد، میتوانیم بینشهایی درباره نقاط قوت و محدودیتهای آن به دست آوریم، سوگیریها یا خطاهای بالقوه را شناسایی کنیم و با کاربران و ذینفعان اعتماد ایجاد کنیم.

در نتیجه، Hanlon’s Razor یک اصل راهنمای ارزشمند در زمینه یادگیری ماشین ارائه می دهد.

با فرض بی کفایتی یا ناآگاهی به جای بدخواهی، میتوانیم به اشتباهات الگوریتمی، سوگیری و چالشهای تفسیرپذیری با ذهنیت حل مسئله برخورد کنیم.

این رویکرد همکاری را تقویت می کند، تحقیقات را تشویق می کند و در نهایت منجر به توسعه سیستم های یادگیری ماشینی قوی تر و قابل اعتمادتر می شود.

بنابراین، دفعه بعد که با رفتار غیرمنتظره ای از الگوریتم یادگیری ماشین مواجه شدید، تیغ هانلون را به خاطر بسپارید و قبل از نتیجه گیری سریع به بی کفایتی فرصت دهید.

تعبیرهای نادرست رایج از تیغ هانلون در یادگیری ماشین

تیغ هانلون یک اصل است که می گوید: “هرگز آنچه را که به اندازه کافی با حماقت توضیح داده شده است به بدخواهی نسبت ندهید.

” ابزار مفیدی برای درک رفتار انسان و اجتناب از فرضیات غیر ضروری است.

با این حال، وقتی صحبت از یادگیری ماشینی می شود، تفسیرهای نادرست رایجی از Hanlon’s Razor وجود دارد که می تواند منجر به سوء تفاهم و تصمیم گیری ناقص شود.

یکی از تفسیرهای نادرست رایج این باور است که هانلون رازور میتواند مستقیماً در الگوریتمهای یادگیری ماشین اعمال شود.

برخی افراد تصور میکنند که اگر یک مدل یادگیری ماشینی اشتباه میکند، باید به دلیل عدم هوش یا نیت مخرب الگوریتم باشد.

این سادهسازی بیش از حد، ماهیت پیچیده یادگیری ماشین و عوامل مختلفی را که میتوانند در ایجاد خطاها نقش داشته باشند، نادیده میگیرد.

در واقعیت، الگوریتمهای یادگیری ماشینی برای یادگیری از دادهها و پیشبینی بر اساس الگوها و همبستگیها طراحی شدهاند.

آنها ذاتاً باهوش یا قادر به سوء نیت نیستند.

زمانی که یک مدل یادگیری ماشینی مرتکب اشتباه می شود، به احتمال زیاد به دلیل محدودیت در داده هایی است که روی آن آموزش دیده است، سوگیری در فرآیند آموزش یا سایر مسائل فنی.

تیغ هانلون، در این زمینه، باید به عنوان یادآوری برای در نظر گرفتن این عوامل قبل از نتیجه گیری سریع در مورد اهداف یا قابلیت های الگوریتم درک شود.

یکی دیگر از تفسیرهای غلط Hanlon’s Razor در یادگیری ماشین، این فرض است که تمام خطاهای ایجاد شده توسط الگوریتم ها به یک اندازه خوش خیم هستند.

برخی از افراد استدلال می کنند که از آنجایی که الگوریتم های یادگیری ماشینی فاقد عمد هستند، اشتباهات آنها باید بخشیده یا نادیده گرفته شود.

با این حال، این دیدگاه نمی تواند پیامدهای بالقوه خطاهای الگوریتمی را تشخیص دهد.

الگوریتم های یادگیری ماشین به طور فزاینده ای در حوزه های حیاتی مانند مراقبت های بهداشتی، مالی و عدالت کیفری مورد استفاده قرار می گیرند.

در این زمینه ها، حتی خطاهای به ظاهر کوچک می توانند تأثیرات قابل توجهی در دنیای واقعی داشته باشند.

Hanlon’s Razor نباید به عنوان بهانه ای برای رد یا کم اهمیت جلوه دادن اهمیت پرداختن به خطاهای الگوریتمی استفاده شود.

در عوض، باید به عنوان یادآوری برای نزدیک شدن به این خطاها با تمرکز بر درک و بهبود فرآیندها و سیستمهای زیربنایی عمل کند.

علاوه بر این، Hanlon’s Razor نباید به عنوان سپری برای جلوگیری از پاسخگویی در قبال تصمیمات اتخاذ شده بر اساس الگوریتم های یادگیری ماشین استفاده شود.

اگرچه درست است که الگوریتمها عمداً مخرب نیستند، اما همچنان میتوانند سوگیریها و نابرابریهای موجود در دادههایی را که بر روی آنها آموزش دیدهاند، تداوم بخشند.

نادیده گرفتن یا نادیده گرفتن این تعصبات تحت پوشش Hanlon’s Razor می تواند نتایج مضر را تداوم بخشد و مانع از پیشرفت به سمت سیستم های منصفانه تر و عادلانه تر شود.

در خاتمه، تیغ هانلون یک اصل ارزشمند برای درک رفتار انسان است، اما کاربرد آن در یادگیری ماشین نیاز به بررسی دقیق دارد.

تفسیر نادرست Hanlon’s Razor می تواند منجر به فرضیات ناقص در مورد اهداف و قابلیت های الگوریتم های یادگیری ماشین شود.

شناخت پیچیدگی یادگیری ماشین و پیامدهای احتمالی خطاهای الگوریتمی مهم است.

Hanlon’s Razor باید بهعنوان یادآوری برای بررسی و رسیدگی به این خطاها استفاده شود، نه بهعنوان بهانهای برای رد یا نادیده گرفتن آنها.

با انجام این کار، میتوانیم اطمینان حاصل کنیم که الگوریتمهای یادگیری ماشین بهطور مسئولانه و اخلاقی در چشمانداز فناوری بهسرعت در حال پیشرفت استفاده میشوند.

نقش تیغ هانلون در تعصب و تجزیه و تحلیل خطا در یادگیری ماشین

به جای اینکه فوراً فرض کنیم که در پس نتایج یا خطاهای مغرضانه قصد سوء وجود دارد، ابتدا باید احتمال اشتباهات یا نادیده گرفتن های ساده را در نظر بگیریم.

این امر به ویژه در زمینه یادگیری ماشینی، که در آن از الگوریتم های پیچیده برای پردازش حجم وسیعی از داده ها استفاده می شود، اهمیت دارد.

با استفاده از Razor هانلون، میتوانیم از نتیجهگیری سریع خودداری کنیم و در عوض بر درک علل ریشهای سوگیریها و خطاها در یادگیری ماشین تمرکز کنیم.

این شامل انجام تجزیه و تحلیل کامل داده ها، الگوریتم و فرآیند آموزش است.

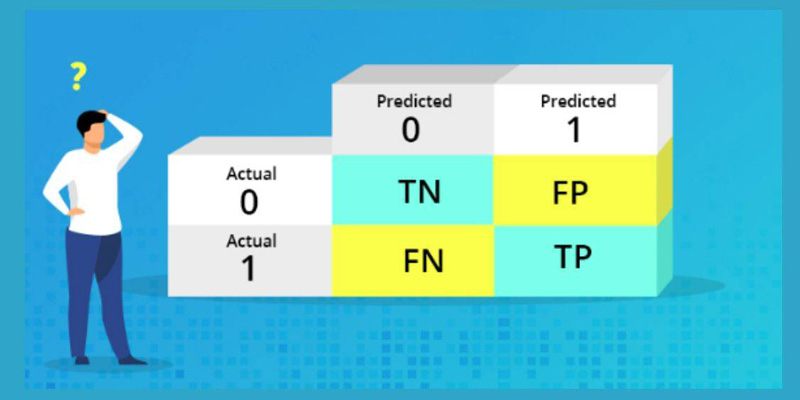

یکی از راههای پیادهسازی Hanlon’s Razor در تجزیه و تحلیل بایاس و خطا از طریق بررسی سیستماتیک دادههای مورد استفاده برای آموزش الگوریتم یادگیری ماشین است.

این شامل شناسایی هر گونه منابع بالقوه سوگیری در داده ها، مانند بازنمایی کمتر از گروه های خاص یا ارائه بیش از حد از دیگران است.

با درک محدودیتهای دادهها، میتوانیم سوگیریهایی را که ممکن است در پیشبینیهای الگوریتم ایجاد شود، بهتر تفسیر کنیم.

یکی دیگر از جنبههای مهم استفاده از Hanlon’s Razor در یادگیری ماشین، بررسی خود الگوریتم است.

این شامل درک نحوه عملکرد الگوریتم، ویژگی هایی است که در نظر می گیرد و چگونه پیش بینی می کند.

با به دست آوردن درک عمیق از الگوریتم، میتوانیم هر منبع احتمالی خطا یا سوگیری را که ممکن است از طراحی یا اجرای آن ناشی شود، شناسایی کنیم.

علاوه بر بررسی داده ها و الگوریتم، تجزیه و تحلیل فرآیند آموزش نیز بسیار مهم است.

این شامل درک نحوه آموزش الگوریتم، چه داده هایی و چه تصمیماتی در طول فرآیند آموزش است.

با بررسی دقیق فرآیند آموزش، میتوانیم هرگونه سوگیری یا خطای احتمالی را که ممکن است در این مرحله معرفی شده باشد، شناسایی کنیم.

با استفاده از Razor هانلون در تجزیه و تحلیل بایاس و خطا، میتوانیم با ذهنی بازتر به این مسائل بپردازیم.

به جای اینکه فوراً فرض کنیم که سوگیری ها یا اشتباهات عمدی هستند، می توانیم احتمال اشتباهات یا نادیده گرفتن غیر عمدی را در نظر بگیریم.

این به ما این امکان را می دهد که به این مسائل به شیوه ای سازنده تر و سازنده تر رسیدگی کنیم.

در نتیجه، Hanlon’s Razor نقش ارزشمندی در تجزیه و تحلیل سوگیری و خطا در یادگیری ماشین ایفا می کند.

با یادآوری اینکه از نسبت دادن سوء نیت به سوگیری ها و اشتباهات خودداری کنیم، می توانیم با دیدی بازتر به این مسائل نزدیک شویم و بر درک علل اصلی آنها تمرکز کنیم.

با بررسی سیستماتیک دادهها، الگوریتم و فرآیند آموزش، میتوانیم سوگیریها و خطاها را به شیوهای مؤثرتر شناسایی و برطرف کنیم.

بنابراین، دفعه بعد که با سوگیری ها یا خطاهایی در یادگیری ماشین مواجه شدید، Hanlon’s Razor را به خاطر بسپارید و با کنجکاوی و تمایل به یادگیری به آنها نزدیک شوید.

استفاده از تیغ هانلون برای ارزیابی مدل و قابلیت تفسیر در یادگیری ماشین

وقتی نوبت به ارزیابی مدلهای یادگیری ماشین میرسد، مهم است که احتمال خطاها یا کاستیها ناشی از ناآگاهی باشد تا دستکاری عمدی.

Hanlon’s Razor به ما یادآوری میکند که با دیدی باز به ارزیابی مدل بپردازیم و این احتمال را در نظر بگیریم که هر مشکلی که با آن مواجه میشویم ممکن است به دلیل محدودیتهای درک یا دادههای ما باشد، نه تخلف عمدی.

یکی از زمینههایی که Hanlon’s Razor میتواند به طور ویژه مفید باشد، در تفسیر تصمیمهای گرفته شده توسط مدلهای یادگیری ماشین است.

از آنجایی که مدلها پیچیدهتر و مبهمتر میشوند، میتوان تصور کرد که هر تصمیم نادرست یا مغرضانه نتیجه سوگیری عمدی یا قصد بدخواهانه است.

با این حال، Razor Hanlon ما را تشویق می کند که ابتدا این احتمال را در نظر بگیریم که این تصمیمات نتیجه پیامدهای ناخواسته یا محدودیت در داده های آموزشی مدل هستند.

برای مثال، فرض کنید یک مدل یادگیری ماشینی داریم که برای پیشبینی اینکه آیا متقاضی وام احتمالاً وام خود را نکول میکند، آموزش دیده است.

اگر مدل به طور مداوم وام به افراد یک گروه جمعیتی خاص را رد کند، ممکن است به راحتی بتوان به این نتیجه رسید که این مدل عمداً علیه آن گروه تبعیض آمیز است.

با این حال، استفاده از تیغ هانلون به ما یادآوری میکند که ابتدا بررسی کنیم که آیا تصمیمات مدل نتیجه دادههای آموزشی مغرضانه است یا سایر عوامل غیرعمدی.

با استفاده از تیغ هانلون، میتوانیم ارزیابی و تفسیرپذیری مدل را با دیدگاه متعادلتری نزدیک کنیم.

به جای اینکه فوراً بدترین را فرض کنیم، میتوانیم یک قدم به عقب برداریم و برای هر مسئلهای که با آن مواجه میشویم، توضیحات جایگزین را در نظر بگیریم.

این می تواند به ما کمک کند از نتیجه گیری سریع و اتهامات بی اساس اجتناب کنیم.

البته، این بدان معنا نیست که ما باید احتمال سوگیری عمدی یا نیت مخرب در مدل های یادگیری ماشین را نادیده بگیریم.

مطمئناً مواردی وجود دارد که چنین عواملی ممکن است نقش داشته باشند، و بررسی کامل هر گونه نگرانی مهم است.

با این حال، با شروع با این فرض که خطاها یا سوگیریها بیشتر نتیجه ناآگاهی هستند تا سوء نیت، میتوانیم به فرآیند ارزیابی به شیوهای سازندهتر و با دید بازتر برخورد کنیم.

در نتیجه، Hanlon’s Razor میتواند یک اصل ارزشمند برای استفاده در هنگام ارزیابی و تفسیر مدلهای یادگیری ماشین باشد.

با یادآوری به خود در نظر گرفتن امکان جهل به جای سوء نیت، میتوانیم با دیدگاه متعادلتری به ارزیابی مدل بپردازیم.

این میتواند به ما کمک کند از نتیجهگیری سریع و اتهامات بیاساس اجتناب کنیم، در حالی که همچنان به ما اجازه میدهد تا نگرانیهای مربوط به سوگیری عمدی یا قصد بدخواهانه را به طور کامل بررسی کنیم.

در نهایت، استفاده از Hanlon’s Razor میتواند به توسعه سیستمهای یادگیری ماشینی منصفانهتر، شفافتر و پاسخگوتر کمک کند.

Hanlon’s Razor and Ethical ملاحظات در یادگیری ماشین

بسیار مهم است که با ذهنی باز به این موقعیت ها نزدیک شویم و این احتمال را در نظر بگیریم که کاستی های الگوریتم به جای سوء نیت عمدی ناشی از اشتباهات یا سهل انگاری های غیرعمدی است.

یکی از حوزههایی که Hanlon’s Razor به ویژه در یادگیری ماشین مرتبط است، در شناسایی سوگیریها است.

الگوریتمهای یادگیری ماشین بر روی دادههای تاریخی آموزش داده میشوند، که ممکن است حاوی سوگیریهایی باشد که منعکسکننده تعصبات یا نابرابریهای اجتماعی است.

سپس این سوگیری ها می تواند توسط الگوریتم تداوم یابد و منجر به نتایج ناعادلانه یا تبعیض آمیز شود.

با این حال، مهم است که به یاد داشته باشید که این سوگیری ها لزوماً نتیجه تبعیض عمدی نیستند، بلکه بازتاب داده هایی هستند که الگوریتم بر اساس آن آموزش داده شده است.

با استفاده از Razor هانلون، میتوانیم با دیدگاهی دقیقتر به موضوع سوگیری در یادگیری ماشین بپردازیم.

به جای اینکه فوراً فرض کنیم که الگوریتم عمداً سوگیری شده است، میتوانیم این احتمال را در نظر بگیریم که سوگیریها غیرعمدی هستند و نتیجه دادههای مورد استفاده برای آموزش هستند.

این طرز فکر به ما اجازه می دهد تا به جای نسبت دادن اهداف مخرب به الگوریتم یا سازندگان آن، روی پرداختن به دلایل اصلی سوگیری، مانند بهبود کیفیت و تنوع داده های آموزشی تمرکز کنیم.

یکی دیگر از جنبه های یادگیری ماشینی که در آن تیغ هانلون وارد عمل می شود، تفسیر تصمیمات الگوریتمی است.

الگوریتمهای یادگیری ماشینی اغلب بهعنوان جعبههای سیاه عمل میکنند، به این معنی که فرآیندهای تصمیمگیری آنها بهراحتی برای انسان قابل درک یا توضیح نیست.

این عدم تفسیرپذیری می تواند منجر به بی اعتمادی و سوء ظن شود، به خصوص زمانی که تصمیمات الگوریتم پیامدهای قابل توجهی در دنیای واقعی داشته باشد.

به جای اینکه بلافاصله فرض کنیم که تصمیمات الگوریتم عمدا مبهم یا بدخواهانه هستند، تیغ هانلون ما را تشویق می کند که این احتمال را در نظر بگیریم که فقدان قابلیت تفسیر نتیجه پیچیدگی یا محدودیت های فنی است تا مبهم سازی عمدی.

این دیدگاه به ما اجازه می دهد تا بر روی توسعه تکنیک ها و ابزارهایی برای توضیح و تفسیر تصمیمات الگوریتمی تمرکز کنیم و در نهایت شفافیت و مسئولیت پذیری را در سیستم های یادگیری ماشین افزایش دهیم.

در پایان، Hanlon’s Razor یک اصل ارزشمند است که باید هنگام در نظر گرفتن ملاحظات اخلاقی در یادگیری ماشین به خاطر داشت.

با به کارگیری این اصل، میتوان با ذهنیتی بازتر و درکتر به موضوعاتی مانند سوگیریها و تفسیرپذیری پرداخت.

به جای نسبت دادن فوری سوء نیت به کاستی های الگوریتمی، می توانیم احتمال خطاها یا نادیده گرفتن های غیرعمدی را در نظر بگیریم.

این رویکرد به ما اجازه میدهد تا به دلایل ریشهای این مسائل بپردازیم و برای ایجاد سیستمهای یادگیری ماشینی عادلانهتر و شفافتر تلاش کنیم.

منبع » آکادمی اشکان مستوفی