مهندسی ویژگی (Feature engineering) در یادگیری ماشینی به بخشی جدایی ناپذیر از زندگی ما تبدیل شده است، از توصیه های شخصی سازی شده در پلتفرم های پخش جریانی گرفته تا خودروهای خودران.

اما آیا تا به حال از خود پرسیده اید که این الگوریتم ها چگونه کار می کنند؟ یکی از جنبه های مهم یادگیری ماشین، مهندسی ویژگی است.

در این مقاله شما را با مفهوم مهندسی ویژگی و اهمیت آن در یادگیری ماشین آشنا می کنیم.

مقدمه ای بر مهندسی ویژگی در یادگیری ماشین

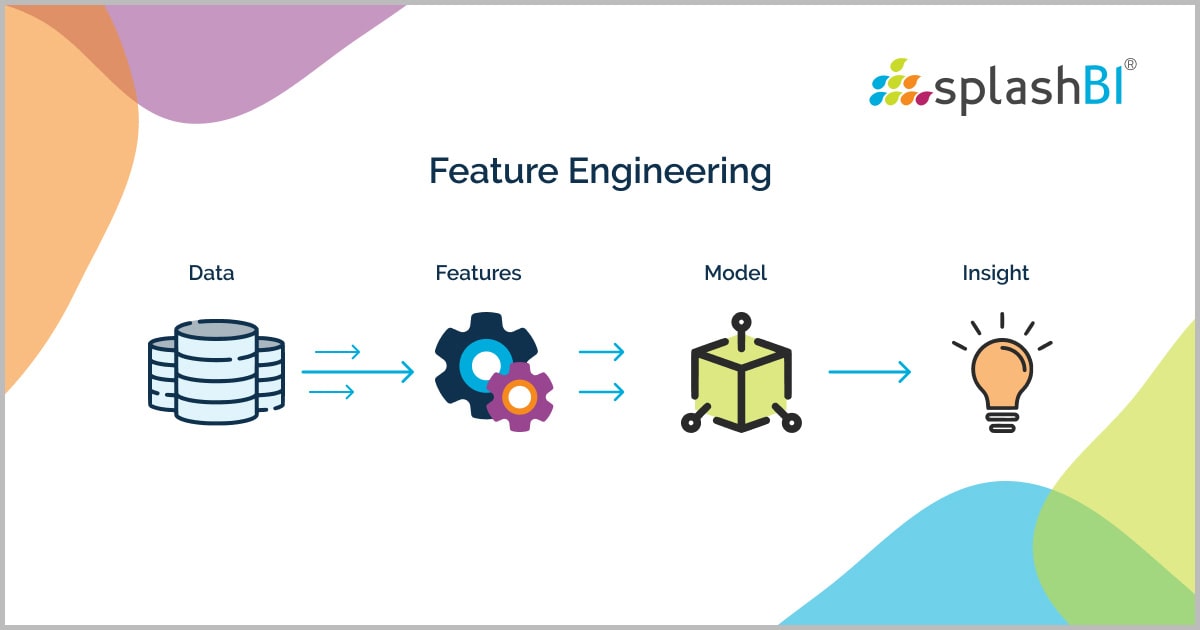

بنابراین، مهندسی ویژگی دقیقا چیست؟ به عبارت ساده، فرآیند انتخاب، تبدیل و ایجاد ویژگیها از دادههای خام برای بهبود عملکرد مدلهای یادگیری ماشین است.

ویژگیها یا ویژگیهای قابل اندازهگیری فردی دادهها هستند که به مدل در پیشبینی یا طبقهبندی کمک میکنند.

آنها می توانند به سادگی مقادیر عددی یا به پیچیدگی متن یا تصاویر باشند.

مهندسی ویژگی نقشی حیاتی در یادگیری ماشین ایفا می کند زیرا کیفیت و ارتباط ویژگی ها به طور مستقیم بر عملکرد مدل تأثیر می گذارد.

مجموعه ای از ویژگی ها به خوبی مهندسی شده می تواند دقت و کارایی مدل را به طور قابل توجهی بهبود بخشد، در حالی که ویژگی های نامربوط یا ضعیف انتخاب شده می تواند منجر به پیش بینی های نادرست یا بیش از حد برازش شود.

یکی از تکنیک های رایج در مهندسی ویژگی، انتخاب ویژگی است.

انتخاب ویژگی

این شامل انتخاب مرتبط ترین ویژگی ها از مجموعه داده های موجود است.

هدف کاهش ابعاد دادهها، آسانتر کردن پردازش مدل و کاهش خطر بیش از حد برازش است.

انتخاب ویژگی را می توان با استفاده از روش های آماری مختلف، مانند تحلیل همبستگی یا به دست آوردن اطلاعات انجام داد.

یکی دیگر از جنبه های مهم مهندسی ویژگی، تبدیل ویژگی است.

تبدیل ویژگی

این شامل تبدیل ویژگی های موجود به یک نمایش مناسب تر برای مدل است.

به عنوان مثال، اگر دادهها دارای متغیرهای طبقهای باشند، میتوان آنها را با استفاده از تکنیکهایی مانند رمزگذاری تک داغ یا رمزگذاری برچسب، به مقادیر عددی کدگذاری کرد.

به طور مشابه، ویژگی های عددی را می توان مقیاس یا نرمال کرد تا اطمینان حاصل شود که محدوده و توزیع مشابهی دارند.

علاوه بر انتخاب و تبدیل ویژگی ها، مهندسی ویژگی همچنین شامل ایجاد ویژگی های جدید از ویژگی های موجود است.

این فرآیند به عنوان ایجاد ویژگی یا استخراج ویژگی شناخته می شود.

این شامل استفاده از دانش دامنه یا عملیات ریاضی برای استخراج ویژگی های جدید است که الگوها یا روابط مهم در داده ها را ثبت می کند.

به عنوان مثال، در وظایف تشخیص تصویر، ویژگی ها را می توان با استفاده از تکنیک هایی مانند تشخیص لبه یا تجزیه و تحلیل بافت استخراج کرد.

مهندسی ویژگی نیاز به درک عمیق داده ها و مشکل در دست دارد.

این شامل ترکیبی از دانش حوزه، خلاقیت و آزمایش است.

این یک رویکرد یک اندازه مناسب برای همه نیست، زیرا مجموعه بهینه ویژگی ها ممکن است بسته به مشکل خاص و مجموعه داده متفاوت باشد.

مزایای مهندسی ویژگی بسیار زیاد است.

اولاً، با ارائه ویژگی های مرتبط و آموزنده تر به بهبود عملکرد مدل کمک می کند.

این به نوبه خود منجر به پیشبینی یا طبقهبندی بهتر میشود.

ثانیاً، مهندسی ویژگی میتواند به کاهش پیچیدگی محاسباتی مدل با کاهش ابعاد دادهها کمک کند.

این باعث میشود که مدل سریعتر و کارآمدتر شود، بهویژه زمانی که با مجموعه دادههای بزرگ سروکار داریم.

در نتیجه، مهندسی ویژگی یک گام مهم در خط لوله یادگیری ماشین است.

این شامل انتخاب، تبدیل و ایجاد ویژگیهایی از دادههای خام برای بهبود عملکرد مدلهای یادگیری ماشین است.

با مهندسی دقیق ویژگیها، میتوانیم دقت، کارایی و قابلیت تفسیر مدلها را افزایش دهیم.

بنابراین، دفعه بعد که با یک الگوریتم یادگیری ماشین روبرو شدید، اهمیت مهندسی ویژگی پشت موفقیت آن را به خاطر بسپارید.

تکنیک های رایج برای ویژگی ها مهندسی در یادگیری ماشین

مهندسی ویژگی گامی مهم در فرآیند یادگیری ماشینی است.

این شامل تبدیل داده های خام به قالبی است که به راحتی توسط الگوریتم های یادگیری ماشین قابل درک و پردازش باشد.

با انتخاب و ایجاد ویژگی های مناسب، می توانیم عملکرد مدل های خود را بهبود بخشیم و پیش بینی های دقیق تری انجام دهیم.

در این مقاله، چند تکنیک رایج برای مهندسی ویژگی در یادگیری ماشین را بررسی خواهیم کرد.

یکی از اساسیترین تکنیکها، مقیاسبندی ویژگی است.

مقیاسبندی ویژگی

این شامل مقیاسبندی همه ویژگیها در یک محدوده خاص است، معمولاً بین 0 و 1 یا -1 و 1.

مقیاسبندی مهم است زیرا تضمین میکند که همه ویژگیها اهمیت یکسانی دارند و از تسلط هر ویژگی بر دیگران جلوگیری میکند.

همچنین در مواردی که ویژگی ها واحدها یا مقیاس های متفاوتی دارند کمک می کند.

یکی دیگر از تکنیکهای رمزگذاری تک داغ است که برای تبدیل متغیرهای طبقهبندی به متغیرهای عددی استفاده میشود.

در یادگیری ماشینی، الگوریتمها معمولاً با دادههای عددی کار میکنند، بنابراین باید متغیرهای طبقهبندی را به قالبی تبدیل کنیم که توسط این الگوریتمها قابل درک باشد.

کدگذاری تک داغ برای هر دسته ستون های باینری ایجاد می کند که مقدار 1 نشان دهنده وجود آن دسته و 0 نشان دهنده عدم وجود آن است.

استخراج ویژگی یکی دیگر از تکنیک های مهم در مهندسی ویژگی است.

این شامل ایجاد ویژگی های جدید از ویژگی های موجود است.

این را می توان با ترکیب چندین ویژگی یا با استخراج اطلاعات مرتبط از یک ویژگی انجام داد.

به عنوان مثال، اگر ویژگی تاریخ داریم، می توانیم روز هفته یا ماه را به عنوان ویژگی جداگانه استخراج کنیم.

استخراج ویژگی به گرفتن الگوها و روابط مهم در داده ها کمک می کند که ممکن است در ویژگی های اصلی آشکار نباشند.

کاهش ابعاد تکنیکی است که برای کاهش تعداد ویژگی ها در یک مجموعه داده استفاده می شود.

این در هنگام برخورد با دادههای با ابعاد بالا مهم است، زیرا بسیاری از ویژگیها میتوانند منجر به تناسب بیش از حد و افزایش پیچیدگی محاسباتی شوند.

تجزیه و تحلیل اجزای اصلی (PCA) یک تکنیک کاهش ابعاد متداول است که مهمترین ویژگی ها را با نمایش داده ها بر روی یک فضای با ابعاد پایین تر شناسایی می کند.

تکنیک دیگر انتخاب ویژگی است که شامل انتخاب زیرمجموعه ای از مرتبط ترین ویژگی ها از مجموعه داده اصلی است.

این مهم است زیرا ممکن است همه ویژگی ها به یک اندازه در قدرت پیش بینی یک مدل نقش نداشته باشند.

انتخاب ویژگی به کاهش نویز و بهبود عملکرد مدل کمک می کند.

روش های مختلفی برای انتخاب ویژگی وجود دارد، مانند تجزیه و تحلیل همبستگی، اطلاعات متقابل و حذف ویژگی های بازگشتی.

علاوه بر این تکنیک ها، دانش دامنه نقش مهمی در مهندسی ویژگی ایفا می کند.

درک دامنه و مشکل موجود می تواند به شناسایی ویژگی های مرتبط و ایجاد ویژگی های جدید کمک کند.

به عنوان مثال، در یک مشکل تشخیص پزشکی، دانش دامنه در مورد علائم و عوامل خطر می تواند در انتخاب و ایجاد ویژگی هایی که بیشتر نشان دهنده یک بیماری خاص هستند کمک کند.

در نتیجه، مهندسی ویژگی یک مرحله مهم در فرآیند یادگیری ماشین است.

این شامل تبدیل داده های خام به قالبی است که به راحتی توسط الگوریتم های یادگیری ماشین قابل درک و پردازش باشد.

تکنیکهای رایج برای مهندسی ویژگیها شامل مقیاسبندی ویژگی، رمزگذاری یکطرفه، استخراج ویژگی، کاهش ابعاد و انتخاب ویژگی است.

علاوه بر این، دانش دامنه در شناسایی ویژگیهای مرتبط و ایجاد ویژگیهای جدید مهم است.

با استفاده از این تکنیکها، میتوانیم عملکرد مدلهای خود را بهبود بخشیم و پیشبینیهای دقیقتری انجام دهیم.

نقش مهندسی ویژگی در مدل عملکرد

یکی از دلایل اصلی اهمیت مهندسی ویژگی این است که الگوریتمهای یادگیری ماشین معمولاً با دادههای عددی بهترین کار را دارند.

با این حال، داده های دنیای واقعی اغلب به شکل های مختلفی مانند متن، تصویر یا متغیرهای طبقه بندی می شوند.

با تبدیل این انواع مختلف داده ها به ویژگی های عددی، می توانیم اطمینان حاصل کنیم که مدل های ما می توانند به طور موثر از آنها یاد بگیرند.

چندین تکنیک وجود دارد که بسته به ماهیت داده ها می تواند برای مهندسی ویژگی استفاده شود.

یکی از رویکردهای رایج، رمزگذاری متغیرهای طبقه بندی شده با استفاده از رمزگذاری تک داغ است.

این شامل ایجاد متغیرهای باینری برای هر دسته در یک ویژگی طبقه بندی می شود.

به عنوان مثال، اگر ما یک ویژگی به نام “color” با دسته بندی هایی مانند قرمز، آبی و سبز داشته باشیم، سه متغیر باینری ایجاد می کنیم: is_red، is_blue و is_green.

این به مدل اجازه می دهد تا رابطه بین هر دسته و متغیر هدف را بدست آورد.

یکی دیگر از جنبه های مهم مهندسی ویژگی، مدیریت داده های از دست رفته است.

مقادیر از دست رفته می تواند به طور قابل توجهی بر عملکرد یک مدل تأثیر بگذارد، زیرا اکثر الگوریتم های یادگیری ماشین نمی توانند آنها را مدیریت کنند.

استراتژیهای مختلفی برای مقابله با دادههای از دست رفته وجود دارد، مانند انتساب، که در آن مقادیر گمشده با مقادیر برآورد شده بر اساس دادههای موجود جایگزین میشوند.

از طرف دیگر، میتوانیم یک متغیر باینری جداگانه ایجاد کنیم تا مشخص کنیم که آیا مقداری وجود ندارد یا نه، و به مدل اجازه میدهد از این اطلاعات بیاموزد.

مقیاس بندی ویژگی یکی دیگر از مراحل مهم در مهندسی ویژگی است.

بسیاری از الگوریتمهای یادگیری ماشینی به مقیاس ویژگیها حساس هستند، به این معنی که ویژگیهایی با مقادیر بزرگتر میتوانند بر فرآیند یادگیری مسلط شوند.

برای رفع این مشکل، میتوانیم ویژگیها را عادی یا استاندارد کنیم تا اطمینان حاصل کنیم که مقیاسهای مشابهی دارند.

عادی سازی ویژگی ها را در محدوده 0 تا 1 مقیاس می کند، در حالی که استانداردسازی آنها را به میانگین 0 و انحراف استاندارد 1 تبدیل می کند.

علاوه بر این تکنیک ها، مهندسی ویژگی همچنین شامل ایجاد ویژگی های جدید از ویژگی های موجود است.

این را می توان از طریق عملیات ریاضی مختلف مانند جمع، تفریق، ضرب یا تقسیم انجام داد.

به عنوان مثال، اگر ویژگی هایی برای قد و وزن داشته باشیم، می توانیم با تقسیم وزن بر مجذور قد، یک ویژگی جدید برای شاخص توده بدنی (BMI) ایجاد کنیم.

این ویژگی های جدید می تواند اطلاعات بیشتری را در اختیار مدل قرار دهد و قدرت پیش بینی آن را بهبود بخشد.

در حالی که مهندسی ویژگی می تواند فرآیندی زمان بر و تکراری باشد، ارزش تلاش را دارد.

مجموعه ای از ویژگی های به خوبی مهندسی شده می تواند تفاوت قابل توجهی در عملکرد یک مدل یادگیری ماشین ایجاد کند.

با تبدیل داده های خام به قالبی که برای تجزیه و تحلیل مناسب تر است، می توانیم بینش های ارزشمندی را استخراج کنیم و پیش بینی های دقیقی انجام دهیم.

در نتیجه، مهندسی ویژگی یک مرحله حیاتی در فرآیند یادگیری ماشین است که می تواند عملکرد یک مدل را به شدت تحت تاثیر قرار دهد.

این شامل تبدیل داده های خام به قالبی است که برای تجزیه و تحلیل و پیش بینی مناسب تر است.

تکنیک هایی مانند رمزگذاری متغیرهای طبقه بندی شده، مدیریت داده های از دست رفته و مقیاس بندی ویژگی ها برای ایجاد ویژگی های موثر ضروری هستند.

علاوه بر این، ایجاد ویژگیهای جدید از ویژگیهای موجود میتواند اطلاعات بیشتری را در اختیار مدل قرار دهد.

با صرف زمان و تلاش برای مهندسی ویژگی، میتوانیم دقت و قابلیت اطمینان مدلهای یادگیری ماشین خود را بهبود بخشیم.

تکنیکهای مهندسی ویژگیهای پیشرفته در ماشین یادگیری

یکی از تکنیک های پیشرفته، مقیاس گذاری ویژگی است.

این شامل مقیاس بندی مقادیر ویژگی ها به یک محدوده خاص، مانند بین 0 و 1 است.

مقیاس بندی مهم است زیرا تضمین می کند که ویژگی هایی با مقادیر بزرگتر بر فرآیند یادگیری تسلط ندارند.

تکنیکهای رایج مقیاسبندی شامل مقیاسبندی و استانداردسازی حداقل حداکثر است.

مقیاسبندی حداقل حداکثر، مقادیر ویژگیها را به یک محدوده خاص مقیاس میدهد، در حالی که استانداردسازی، مقادیر ویژگیها را به صفر میانگین و واریانس واحد تبدیل میکند.

یکی دیگر از تکنیک های پیشرفته انتخاب ویژگی است.

این شامل انتخاب زیرمجموعه ای از ویژگی هایی است که بیشترین ارتباط را با متغیر هدف دارند.

انتخاب ویژگی مهم است زیرا ابعاد داده ها را کاهش می دهد که می تواند عملکرد مدل های یادگیری ماشین را بهبود بخشد.

چندین تکنیک انتخاب ویژگی وجود دارد، مانند روشهای فیلتر، روشهای پوششی و روشهای تعبیهشده.

روشهای فیلتر، ارتباط ویژگیها را بر اساس معیارهای آماری ارزیابی میکنند، در حالی که روشهای wrapper از یک الگوریتم یادگیری ماشینی خاص برای ارزیابی ارتباط ویژگیها استفاده میکنند.

روشهای تعبیهشده، انتخاب ویژگی را در خود فرآیند یادگیری گنجاندهاند.

استخراج ویژگی یکی دیگر از تکنیک های پیشرفته در مهندسی ویژگی است.

این شامل ایجاد ویژگی های جدید از ویژگی های موجود است.

این را می توان از طریق تکنیک هایی مانند تجزیه و تحلیل مؤلفه اصلی (PCA) و تجزیه و تحلیل تشخیص خطی (LDA) انجام داد.

PCA جهت هایی را که داده ها در آنها بیشترین تغییر را دارند شناسایی می کند و داده ها را بر روی این جهت ها پخش می کند.

LDA، از طرف دیگر، جهت هایی را پیدا می کند که جدایی بین کلاس های مختلف را به حداکثر می رساند.

با ایجاد ویژگیهای جدید که مهمترین اطلاعات را در دادهها ثبت میکند، استخراج ویژگی میتواند عملکرد مدلهای یادگیری ماشین را بهبود بخشد.

یکی دیگر از تکنیک های پیشرفته ساخت ویژگی است.

این شامل ایجاد ویژگی های جدید بر اساس دانش دامنه یا اکتشافی است.

به عنوان مثال، در یک کار طبقه بندی متن، ویژگی ها را می توان بر اساس وجود یا عدم وجود کلمات یا عبارات خاص ساخت.

ساخت ویژگی نیاز به درک عمیق از حوزه مشکل دارد و می تواند زمان بر باشد.

با این حال، می تواند به بهبود قابل توجهی در عملکرد مدل منجر شود.

علاوه بر این تکنیک ها، تکنیک های مهندسی ویژگی های پیشرفته دیگری نیز وجود دارد که می توان از آنها در سناریوهای خاص استفاده کرد.

به عنوان مثال، در تجزیه و تحلیل سری های زمانی، ویژگی های تاخیر را می توان با جابجایی مقادیر یک ویژگی به جلو یا عقب در زمان ایجاد کرد.

در طبقه بندی تصاویر، ویژگی ها را می توان با استفاده از شبکه های عصبی کانولوشن (CNN) استخراج کرد.

این تکنیکها اهمیت تطبیق تکنیکهای مهندسی ویژگیها را برای مشکل خاص مورد نظر برجسته میکنند.

در نتیجه، تکنیکهای مهندسی ویژگیهای پیشرفته میتوانند عملکرد مدلهای یادگیری ماشین را تا حد زیادی افزایش دهند.

تکنیک هایی مانند مقیاس بندی ویژگی، انتخاب ویژگی، استخراج ویژگی و ساخت ویژگی همگی می توانند به عملکرد بهتر مدل کمک کنند.

مهم است که به دقت در نظر بگیرید که کدام تکنیک ها را بر اساس حوزه مشکل و ویژگی های داده ها اعمال کنید.

با صرف زمان و تلاش برای مهندسی ویژگی های پیشرفته، متخصصان یادگیری ماشین می توانند پتانسیل کامل مدل های خود را باز کنند.

بهترین روش ها برای ویژگی ها مهندسی در یادگیری ماشین

داشتن درک خوب از مشکلی که سعی در حل آن دارید و داده هایی که با آن کار می کنید ضروری است.

این دانش به شما کمک میکند ویژگیهای مرتبط را شناسایی کنید و تصمیمگیری آگاهانه در مورد چگونگی تغییر آنها بگیرید.

بهترین روش دیگر این است که داده های از دست رفته را به طور مناسب مدیریت کنید.

داده های از دست رفته می تواند تأثیر قابل توجهی بر عملکرد یک مدل یادگیری ماشینی داشته باشد.

چندین استراتژی برای مقابله با داده های از دست رفته وجود دارد، مانند انتساب یا حذف ردیف هایی با مقادیر از دست رفته.

انتخاب استراتژی به مشکل و مجموعه داده خاص بستگی دارد.

مقیاس بندی ویژگی یکی دیگر از ملاحظات مهم در مهندسی ویژگی است.

بسیاری از الگوریتمهای یادگیری ماشین زمانی که ویژگیها در مقیاس مشابهی هستند، عملکرد بهتری دارند.

مقیاس گذاری ویژگی ها می تواند به جلوگیری از تسلط برخی ویژگی ها بر فرآیند یادگیری مدل کمک کند.

تکنیک های رایج مقیاس بندی شامل استانداردسازی و نرمال سازی است.

یکی از تکنیک های رایج در مهندسی ویژگی، ایجاد ویژگی های تعاملی است.

ویژگی های تعاملی از ترکیب دو یا چند ویژگی موجود به دست می آیند.

این ویژگیها میتوانند روابط پیچیدهای را بین متغیرها ثبت کنند که ممکن است هنگام در نظر گرفتن جداگانه آنها آشکار نباشد.

به عنوان مثال، اگر ویژگی هایی برای قد و وزن دارید، می توانید با ضرب کردن آنها در یکدیگر یک ویژگی تعامل ایجاد کنید تا مفهوم شاخص توده بدن را به تصویر بکشید.

انتخاب ویژگی یکی دیگر از مراحل مهم در مهندسی ویژگی است.

این شامل انتخاب زیرمجموعه ای از مرتبط ترین ویژگی ها برای مدل است.

داشتن ویژگی های بیش از حد می تواند منجر به بیش از حد برازش شود، جایی که مدل در داده های آموزشی عملکرد خوبی دارد اما در داده های جدید و دیده نشده ضعیف عمل می کند.

تکنیک های مختلفی برای انتخاب ویژگی وجود دارد، مانند تجزیه و تحلیل همبستگی، انتخاب رو به جلو/عقب، یا استفاده از روش های منظم سازی مانند منظم سازی L1 یا L2.

علاوه بر ایجاد ویژگی های جدید و انتخاب موارد مرتبط، در نظر گرفتن رمزگذاری ویژگی نیز مهم است.

الگوریتمهای یادگیری ماشین معمولاً به ورودیهای عددی نیاز دارند، بنابراین متغیرهای طبقهبندی باید به طور مناسب کدگذاری شوند.

رمزگذاری تک داغ یک تکنیک رایج برای تبدیل متغیرهای طبقه بندی شده به بردارهای باینری است.

روش دیگر رمزگذاری برچسب است که در آن به هر دسته یک مقدار عددی منحصر به فرد اختصاص داده می شود.

مهندسی ویژگی یک فرآیند تکراری است.

ارزیابی تاثیر ویژگی های مهندسی شده بر عملکرد مدل ضروری است.

این را می توان از طریق اعتبارسنجی متقابل یا با تقسیم داده ها به مجموعه های آموزشی و اعتبار سنجی انجام داد.

با ارزیابی عملکرد مدل با تکنیک های مختلف مهندسی ویژگی، می توانید موثرترین آنها را شناسایی کرده و رویکرد خود را اصلاح کنید.

در نتیجه، مهندسی ویژگی یک مرحله مهم در فرآیند یادگیری ماشین است.

با انتخاب و تبدیل متغیرها در یک مجموعه داده، می توانید عملکرد یک مدل یادگیری ماشینی را بهبود بخشید.

بهترین روشها برای مهندسی ویژگی شامل درک دانش دامنه، مدیریت دادههای از دست رفته، مقیاسبندی ویژگیها، ایجاد ویژگیهای تعامل، انتخاب ویژگیهای مرتبط، رمزگذاری متغیرهای طبقهبندی، و ارزیابی تأثیر مهندسی ویژگی بر عملکرد مدل است.

با پیروی از این بهترین شیوه ها، می توانید دقت و اثربخشی مدل های یادگیری ماشینی خود را افزایش دهید.

منبع » آکادمی اشکان مستوفی