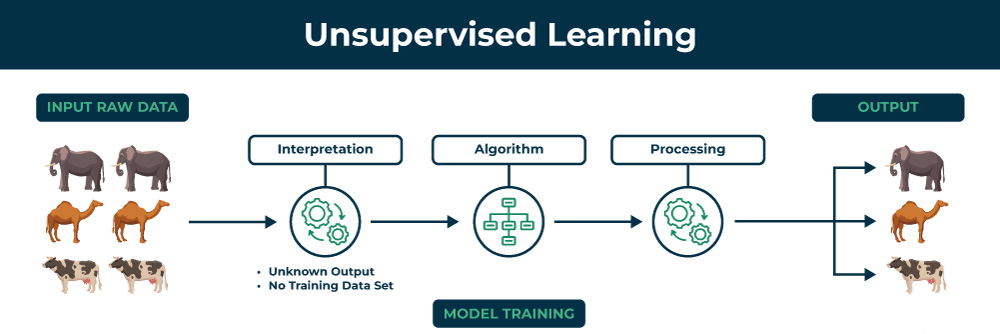

یادگیری بدون نظارت یا unsupervised learning یک زمینه مطالعاتی جذاب است که در سال های اخیر توجه قابل توجهی را به خود جلب کرده است. این شاخه ای از یادگیری ماشینی است که بر یافتن الگوها و روابط در داده ها بدون نیاز به نظارت صریح یا نمونه های برچسب گذاری شده تمرکز دارد.

به عبارت دیگر، الگوریتم های یادگیری بدون نظارت برای کشف ساختارها و بینش های پنهان در یک مجموعه داده به تنهایی طراحی شده اند.

برخلاف یادگیری تحت نظارت، که در آن الگوریتم با دادههای برچسبگذاری شده برای یادگیری از آن ارائه میشود، الگوریتمهای یادگیری بدون نظارت با دادههای بدون برچسب کار میکنند.

این بدان معنی است که الگوریتم هیچ دانش قبلی از داده ها ندارد و باید صرفاً بر توانایی خود در شناسایی الگوها و شباهت ها در مجموعه داده تکیه کند.

این امر یادگیری بدون نظارت را به ویژه در شرایطی که داده های برچسب گذاری شده کمیاب یا گران است مفید می کند.

unsupervised learning

یکی از رایج ترین کاربردهای یادگیری بدون نظارت، خوشه بندی است. هدف الگوریتم های خوشه بندی این است که نقاط داده مشابه را بر اساس ویژگی های ذاتی آنها گروه بندی کنند.

با شناسایی خوشهها در یک مجموعه داده، الگوریتمهای یادگیری بدون نظارت میتوانند به کشف الگوها و ساختارهای پنهانی کمک کنند که ممکن است بلافاصله آشکار نشوند.

این می تواند در حوزه های مختلف مانند تقسیم بندی مشتری، تشخیص ناهنجاری و تشخیص تصویر بسیار ارزشمند باشد.

مفهوم مهم دیگر در یادگیری بدون نظارت، کاهش ابعاد است.

در بسیاری از مجموعه دادههای دنیای واقعی، تعداد ویژگیها یا متغیرها میتواند بسیار زیاد باشد، که تجزیه و تحلیل و تجسم دادهها را به طور موثر دشوار میکند.

هدف تکنیکهای کاهش ابعاد کاهش تعداد ویژگیها و در عین حال حفظ مهمترین اطلاعات است.

این نه تنها داده ها را ساده می کند، بلکه به بهبود عملکرد سایر الگوریتم های یادگیری ماشینی که ممکن است بعداً اعمال شوند نیز کمک می کند.

یکی از روش های محبوب کاهش ابعاد، آنالیز مؤلفه اصلی (PCA) است.

PCA با تبدیل ویژگی های اصلی به مجموعه جدیدی از متغیرهای نامرتبط به نام مؤلفه های اصلی کار می کند.

این مولفه های اصلی به گونه ای مرتب شده اند که مولفه اول حداکثر مقدار واریانس داده ها را ثبت می کند و به دنبال آن جزء دوم و غیره. با انتخاب زیرمجموعه ای از اجزای اصلی، ابعاد داده ها را می توان کاهش داد و در عین حال بیشتر اطلاعات را حفظ کرد.

همچنین می توان از الگوریتم های یادگیری بدون نظارت برای تشخیص ناهنجاری استفاده کرد.

ناهنجاری ها یا نقاط پرت، نقاط داده ای هستند که به طور قابل توجهی از رفتار عادی مجموعه داده منحرف می شوند.

با شناسایی این ناهنجاریها، الگوریتمهای یادگیری بدون نظارت میتوانند به شناسایی تراکنشهای جعلی، نفوذ در شبکه یا هر رویداد غیرعادی دیگری که ممکن است نیاز به توجه داشته باشد کمک کند.

در نتیجه، یادگیری بدون نظارت ابزار قدرتمندی در زمینه یادگیری ماشینی است که به ما امکان می دهد الگوها و ساختارهای پنهان را در داده های بدون برچسب کشف کنیم.

با استفاده از الگوریتمهای خوشهبندی، تکنیکهای کاهش ابعاد و روشهای تشخیص ناهنجاری، یادگیری بدون نظارت میتواند بینشهای ارزشمندی ارائه دهد و به حل مسائل پیچیده در حوزههای مختلف کمک کند.

با ادامه پیشرفت این رشته، میتوانیم انتظار برنامهها و پیشرفتهای هیجانانگیزتری در یادگیری بدون نظارت داشته باشیم.

کاوش الگوریتمهای خوشهبندی در یادگیری بدون نظارت

یکی از کاربردهای رایج یادگیری بدون نظارت، خوشه بندی است.

هدف الگوریتم های خوشه بندی این است که نقاط داده مشابه را بر اساس ویژگی ها یا ویژگی های آنها گروه بندی کنند.

با انجام این کار، این الگوریتمها میتوانند به شناسایی الگوها و ساختارهای درون دادهها کمک کنند که ممکن است بلافاصله آشکار نشوند.

چندین الگوریتم خوشه بندی محبوب در یادگیری بدون نظارت استفاده می شود.

یکی از این الگوریتمها، خوشهبندی k-means است. K-means با پارتیشن بندی داده ها به k خوشه ها کار می کند، جایی که k یک پارامتر تعریف شده توسط کاربر است.

الگوریتم با تخصیص تصادفی هر نقطه داده به یکی از خوشه ها شروع می شود.

سپس به طور مکرر مرکزهای خوشه را بر اساس میانگین نقاط داده اختصاص داده شده به هر خوشه به روز می کند.

این روند تا زمانی ادامه می یابد که مرکزها دیگر تغییر قابل توجهی نداشته باشند که نشان دهنده همگرایی است.

یکی دیگر از الگوریتمهای خوشهبندی رایج، خوشهبندی سلسله مراتبی است. خوشهبندی سلسله مراتبی سلسله مراتبی از خوشهها را با ادغام یا تقسیم مکرر خوشههای موجود ایجاد میکند.

الگوریتم با هر نقطه داده به عنوان خوشه خود شروع می شود و سپس به ادغام شبیه ترین خوشه ها با یکدیگر ادامه می دهد.

این فرآیند تا زمانی ادامه می یابد که تمام نقاط داده متعلق به یک خوشه واحد باشند یا تا زمانی که یک معیار توقف برآورده شود.

الگوریتمهای خوشهبندی مبتنی بر چگالی، مانند DBSCAN (خوشهبندی فضایی مبتنی بر چگالی برنامهها با نویز)، در یادگیری بدون نظارت نیز محبوب هستند.

این الگوریتمها به جای تعریف صریح تعداد خوشهها، نقاط داده را بر اساس چگالی آنها گروهبندی میکنند. به عنوان مثال، DBSCAN، خوشه ها را به عنوان مناطق متراکم که توسط مناطق پراکنده از هم جدا شده اند تعریف می کند.

هر نقطه داده را در صورتی به یک خوشه اختصاص می دهد که تعداد کافی نقاط همسایه در یک شعاع مشخص داشته باشد.

هر الگوریتم خوشه بندی نقاط قوت و ضعف خود را دارد و انتخاب الگوریتم به مسئله و مجموعه داده خاص در دست بستگی دارد.

به عنوان مثال، K-means از نظر محاسباتی کارآمد است و زمانی که خوشه ها به خوبی از هم جدا شده اند و شکل تقریباً کروی دارند، به خوبی کار می کند.

با این حال، ممکن است با خوشههای غیرخطی قابل تفکیک یا خوشههایی با اندازههای مختلف مبارزه کند.

از طرف دیگر، خوشهبندی سلسله مراتبی میتواند خوشههایی با اشکال و اندازههای مختلف را مدیریت کند، اما میتواند از نظر محاسباتی برای مجموعههای داده بزرگ گران باشد.

الگوریتم های یادگیری و خوشه بندی بدون نظارت طیف وسیعی از کاربردها در حوزه های مختلف دارند.

برای مثال، در زیستشناسی، الگوریتمهای خوشهبندی را میتوان برای گروهبندی ژنهایی با الگوهای بیان مشابه استفاده کرد و به محققان در درک فرآیندهای بیولوژیکی زیربنایی کمک کرد.

در بازاریابی، خوشهبندی میتواند برای تقسیمبندی مشتریان بر اساس رفتار خرید آنها استفاده شود و کمپینهای بازاریابی هدفمند را ممکن میسازد.

در تجزیه و تحلیل تصویر، الگوریتمهای خوشهبندی میتوانند برای گروهبندی تصاویر مشابه با هم استفاده شوند و به کارهایی مانند بازیابی تصویر و تشخیص اشیا کمک کنند.

در نتیجه، یادگیری بدون نظارت یک رویکرد قدرتمند برای کشف و درک مجموعه داده های پیچیده است.

الگوریتمهای خوشهبندی، مانند k-means، خوشهبندی سلسله مراتبی و خوشهبندی مبتنی بر چگالی، معمولاً در یادگیری بدون نظارت برای کشف الگوها و ساختارها در دادهها استفاده میشوند.

انتخاب الگوریتم به مسئله و مجموعه داده خاص بستگی دارد و هر الگوریتم نقاط قوت و ضعف خود را دارد.

الگوریتمهای یادگیری و خوشهبندی بدون نظارت، با طیف وسیعی از کاربردهای خود، همچنان نقش مهمی در زمینههای مختلف بازی میکنند و به محققان و متخصصان کمک میکنند تا از دادههای بدون برچسب اطلاعاتی کسب کنند.

مروری بر تکنیکهای کاهش ابعاد در یادگیری بدون نظارت

یادگیری بدون نظارت شاخهای از یادگیری ماشین است که با یافتن الگوها و روابط در دادهها بدون نیاز به نظارت صریح یا مثالهای برچسبگذاری شده سر و کار دارد.

این ابزار قدرتمندی است که به رایانهها اجازه میدهد بدون دخالت انسان، دادهها را به تنهایی یاد بگیرند و معنا پیدا کنند.

یکی از جنبه های مهم یادگیری بدون نظارت، کاهش ابعاد است.

هدف این تکنیک کاهش تعداد متغیرها یا ویژگیها در یک مجموعه داده و در عین حال حفظ تا حد امکان اطلاعات است.

با انجام این کار، به سادهسازی دادهها و قابل مدیریت کردن آنها برای تجزیه و تحلیل بیشتر کمک میکند.

چندین تکنیک کاهش ابعاد وجود دارد که معمولاً در یادگیری بدون نظارت استفاده می شود.

تجزیه و تحلیل اجزای اصلی (PCA)

یکی از محبوب ترین آنها، تجزیه و تحلیل اجزای اصلی (PCA) است. PCA با تبدیل متغیرهای اصلی به مجموعه جدیدی از متغیرهای غیر همبسته به نام اجزای اصلی کار می کند.

این مولفه ها به گونه ای مرتب شده اند که اولی بیشترین واریانس را در داده ها، دومی بیشترین واریانس را ثبت می کند و غیره.

با انتخاب زیرمجموعه ای از این مؤلفه ها، می توانیم ابعاد داده ها را به طور مؤثر کاهش دهیم.

تجزیه ارزش منفرد (SVD)

یکی دیگر از تکنیک های پرکاربرد تجزیه ارزش منفرد (SVD) است. SVD یک روش فاکتورسازی ماتریسی است که یک ماتریس را به سه ماتریس جداگانه تجزیه میکند: U، Σ و V. ماتریس Σ حاوی مقادیر منفرد است که نشاندهنده اهمیت هر بعد در دادهها است.

با انتخاب زیر مجموعه ای از این مقادیر منفرد، می توانیم ابعاد داده ها را کاهش دهیم و در عین حال بیشتر اطلاعات آن را حفظ کنیم.

عاملسازی ماتریس غیرمنفی (NMF)

عاملسازی ماتریس غیرمنفی (NMF) یکی دیگر از تکنیکهای کاهش ابعاد است که معمولاً در یادگیری بدون نظارت استفاده میشود.

هدف NMF فاکتورسازی یک ماتریس غیر منفی به دو ماتریس غیر منفی است که میتوانند به عنوان بردارهای پایه و ضرایب تفسیر شوند.

با انتخاب زیرمجموعه ای از این بردارهای پایه، می توانیم به طور موثر ابعاد داده ها را کاهش دهیم و در عین حال غیر منفی بودن آن را حفظ کنیم.

علاوه بر این تکنیک ها، الگوریتم های خوشه بندی نیز وجود دارد که می توان از آنها برای کاهش ابعاد استفاده کرد.

خوشه بندی فرآیند گروه بندی نقاط داده مشابه با هم بر اساس ویژگی های آنها است. با اختصاص دادن هر نقطه داده به یک خوشه، میتوانیم بهطور مؤثری ابعاد دادهها را با نمایش آنها با برچسبهای خوشهای به جای ویژگیهای اصلی کاهش دهیم.

خوشهبندی k-means

یکی از الگوریتمهای خوشهبندی محبوب که برای کاهش ابعاد استفاده میشود، خوشهبندی k-means است.

K-means با تخصیص مکرر نقاط داده به نزدیکترین مرکز و به روز رسانی مرکزها بر اساس نقاط داده اختصاص داده شده کار می کند.

با انتخاب زیرمجموعهای از مرکزها، میتوانیم به طور موثر ابعاد دادهها را کاهش دهیم و در عین حال ساختار زیربنایی آن را نیز ثبت کنیم.

به طور کلی، تکنیکهای کاهش ابعاد با سادهسازی دادهها و مدیریتپذیرتر کردن آنها برای تجزیه و تحلیل بیشتر، نقش مهمی در یادگیری بدون نظارت بازی میکنند.

چه از طریق تکنیکهایی مانند PCA، SVD، NMF یا الگوریتمهای خوشهبندی مانند k-means باشد، این روشها به ما امکان میدهند تعداد متغیرها یا ویژگیهای یک مجموعه داده را کاهش دهیم و در عین حال بیشتر اطلاعات آن را حفظ کنیم.

با انجام این کار، می توانیم بینش های ارزشمندی به دست آوریم و بر اساس الگوها و روابط کشف شده در داده ها تصمیمات بهتری بگیریم.

برنامه های آموزشی بدون نظارت در پردازش زبان طبیعی

برنامه های یادگیری بدون نظارت در پردازش زبان طبیعی

یادگیری بدون نظارت شاخهای از یادگیری ماشینی است که شامل مدلهای آموزشی بدون دادههای برچسبگذاری شده است.

بر خلاف یادگیری نظارت شده، که در آن مدل با نمونههای برچسبگذاری شده برای یادگیری ارائه میشود، الگوریتمهای یادگیری بدون نظارت با دادههای بدون برچسب کار میکنند و هدفشان یافتن الگوها یا ساختارهای درون دادهها به تنهایی است.

پردازش زبان طبیعی (NLP)

این رویکرد در سالهای اخیر به دلیل کاربردهای بالقوه آن در زمینههای مختلف، از جمله پردازش زبان طبیعی (NLP) مورد توجه قرار گرفته است.

NLP زیر شاخه ای از هوش مصنوعی است که بر تعامل بین کامپیوتر و زبان انسان تمرکز دارد.

این شامل کارهایی مانند ترجمه زبان، تجزیه و تحلیل احساسات، خلاصه سازی متن و موارد دیگر است.

تکنیک های یادگیری بدون نظارت به ویژه در NLP مفید هستند، زیرا می توانند به کشف الگوها و ساختارهای پنهان در مقادیر زیادی از داده های متنی کمک کنند.

یکی از کاربردهای اولیه یادگیری بدون نظارت در NLP مدل سازی موضوعی است. مدلسازی موضوع تکنیکی است که برای کشف مضامین یا موضوعات اصلی در مجموعهای از اسناد استفاده میشود.

با استفاده از الگوریتمهای یادگیری بدون نظارت، مانند تخصیص دیریکله پنهان (LDA) یا فاکتورسازی ماتریس غیر منفی (NMF)، به مجموعهای از متن، میتوان موضوعات زیربنایی را بدون دانش قبلی یا دادههای برچسبگذاری شده شناسایی کرد.

این می تواند در حوزه های مختلف مانند تجزیه و تحلیل اخبار، تجزیه و تحلیل بازخورد مشتری و سیستم های توصیه محتوا بسیار ارزشمند باشد.

یکی دیگر از کاربردهای مهم یادگیری بدون نظارت در NLP، جاسازی کلمات است.

تعبیههای کلمه، بازنماییهای برداری متراکمی از کلمات هستند که روابط معنایی بین آنها را نشان میدهند.

رویکردهای سنتی برای جاسازی کلمات، مانند مدلهای رمزگذاری یکطرفه یا کیسهای از کلمات، محدودیتهایی در درک معنای کلمات دارند.

با این حال، تکنیکهای یادگیری بدون نظارت مانند Word2Vec یا GloVe میتوانند با تجزیه و تحلیل مقادیر زیادی از دادههای متنی بدون برچسب، جاسازیهای کلمه را یاد بگیرند.

سپس میتوان از این تعبیهها در کارهای مختلف NLP، مانند تجزیه و تحلیل احساسات، شناسایی موجودیت نامگذاری شده یا ترجمه ماشینی برای بهبود عملکرد مدلها استفاده کرد.

خوشه بندی حوزه دیگری است که یادگیری بدون نظارت در NLP کاربرد خود را پیدا می کند.

الگوریتم های خوشه بندی، اسناد یا کلمات مشابه را بر اساس شباهت آنها از نظر محتوا یا زمینه، در کنار هم قرار می دهند.

این می تواند در کارهایی مانند دسته بندی اسناد، بازیابی اطلاعات یا سیستم های توصیه مفید باشد. الگوریتمهای خوشهبندی بدون نظارت، مانند K-means یا خوشهبندی سلسله مراتبی، میتوانند بهطور خودکار اسناد یا کلمات مشابه را بدون هیچ دانش قبلی یا دادههای برچسبگذاری شده گروهبندی کنند و در برنامههای NLP بسیار ارزشمند باشند.

علاوه بر این، تکنیک های یادگیری بدون نظارت نیز می توانند برای تشخیص ناهنجاری در NLP استفاده شوند. تشخیص ناهنجاری شامل شناسایی موارد نادر یا غیر معمول در یک مجموعه داده است.

در زمینه NLP، این می تواند برای شناسایی ایمیل های اسپم، بررسی های تقلبی، یا الگوهای غیرعادی در داده های متنی اعمال شود.

با آموزش مدلهای یادگیری بدون نظارت بر روی مجموعه بزرگی از دادههای متنی معمولی، هر گونه انحراف از الگوهای آموختهشده را میتوان به عنوان یک ناهنجاری علامتگذاری کرد که امکان شناسایی و پیشگیری مؤثر از رفتارهای مخرب یا غیرعادی را فراهم میکند.

در نتیجه، یادگیری بدون نظارت به عنوان یک ابزار قدرتمند در زمینه پردازش زبان طبیعی ظاهر شده است.

توانایی آن در کشف الگوهای پنهان، ایجاد جاسازی کلمات، انجام خوشه بندی، و تشخیص ناهنجاری ها بدون هیچ گونه داده برچسب گذاری شده، آن را در برنامه های مختلف NLP بسیار ارزشمند می کند.

از آنجایی که مقدار داده های متنی به طور تصاعدی در حال رشد است، تکنیک های یادگیری بدون نظارت نقش مهمی در استخراج بینش های معنادار و بهبود عملکرد مدل های NLP ایفا خواهند کرد.

یادگیری بدون نظارت در سیستم های توصیه گر: راهنمای جامع

یکی از زمینه هایی که در آن یادگیری بدون نظارت به ویژه مفید است، در سیستم های توصیه کننده است.

سیستمهای توصیهکننده الگوریتمهایی هستند که اقلام یا محتوا را بر اساس ترجیحات و رفتار کاربران به آنها پیشنهاد میدهند.

آنها به طور گسترده در حوزه های مختلف مانند تجارت الکترونیک، رسانه های اجتماعی و پلت فرم های سرگرمی استفاده می شوند.

به طور سنتی، سیستمهای توصیهگر بر تکنیکهای یادگیری نظارت شده تکیه میکنند، که در آن الگوریتم بر روی دادههای برچسبگذاری شده آموزش داده میشود، یعنی دادههایی که به صراحت با اولویتها یا رتبهبندیهای کاربر برچسبگذاری شدهاند.

با این حال، این رویکرد محدودیت های خود را دارد. جمعآوری دادههای برچسبگذاری شده میتواند گران و زمانبر باشد و ممکن است همیشه در دسترس نباشد.

علاوه بر این، الگوریتمهای یادگیری تحت نظارت فقط میتوانند بر اساس دادههای برچسبگذاری شدهای که روی آنها آموزش دیدهاند، توصیههایی ارائه دهند، که میتواند به توصیههای محدود و مغرضانه منجر شود.

اینجاست که یادگیری بدون نظارت وارد می شود. با استفاده از تکنیک های یادگیری بدون نظارت، سیستم های توصیه گر می توانند بر این محدودیت ها غلبه کنند و توصیه های دقیق و متنوع تری ارائه دهند.

الگوریتم های یادگیری بدون نظارت می توانند مقادیر زیادی از داده های بدون برچسب را تجزیه و تحلیل کنند و الگوهای پنهان و شباهت های بین آیتم ها یا کاربران را شناسایی کنند.

این به آنها اجازه میدهد تا توصیههایی را براساس این الگوها ارائه دهند، نه اینکه صرفاً بر ترجیحات صریح کاربر تکیه کنند.

یکی از روش های رایج یادگیری بدون نظارت که در سیستم های توصیه گر استفاده می شود، خوشه بندی است. الگوریتم های خوشه بندی اقلام یا کاربران مشابه را بر اساس ویژگی ها یا رفتارشان با هم گروه بندی می کنند.

برای مثال، در یک پلتفرم تجارت الکترونیک، الگوریتمهای خوشهبندی میتوانند محصولات مشابه را بر اساس ویژگیهایشان، مانند قیمت، نام تجاری یا دستهبندی، با هم گروهبندی کنند.

این به سیستم توصیهکننده اجازه میدهد تا محصولات مشابهی را بر اساس خریدهای قبلی یا سابقه مرور کاربران به کاربران پیشنهاد دهد.

یکی دیگر از تکنیک های یادگیری بدون نظارت مورد استفاده در سیستم های توصیه گر کاهش ابعاد است. الگوریتمهای کاهش ابعاد تعداد ویژگیها یا متغیرهای یک مجموعه داده را کاهش میدهند و در عین حال اطلاعات مهم آن را حفظ میکنند.

این می تواند به ویژه در سیستم های توصیه گر مفید باشد، جایی که تعداد آیتم ها یا کاربران می تواند بسیار زیاد باشد.

با کاهش ابعاد داده ها، سیستم های توصیه گر می توانند توصیه های کارآمدتر و دقیق تری ارائه دهند.

یادگیری بدون نظارت در سیستم های توصیه گر نیز امکان کشف توصیه های جدید و غیرمنتظره را فراهم می کند.

از آنجایی که الگوریتمهای یادگیری بدون نظارت میتوانند الگوها و شباهتهای پنهان را شناسایی کنند، میتوانند مواردی را پیشنهاد کنند که کاربران ممکن است قبلاً در نظر نگرفته باشند. این می تواند منجر به اکتشافات سرسام آور شود و تجربه کاربر را افزایش دهد.

با این حال، توجه به این نکته مهم است که یادگیری بدون نظارت در سیستم های توصیه گر بدون چالش نیست.

یکی از چالشهای اصلی مشکل شروع سرد است، جایی که سیستم توصیهکننده اطلاعات محدودی در مورد یک کاربر یا مورد جدید دارد یا هیچ اطلاعاتی ندارد. در چنین مواردی، سیستم ممکن است در ارائه توصیه های دقیق دچار مشکل شود.

برای پرداختن به این موضوع، رویکردهای ترکیبی که تکنیکهای یادگیری بدون نظارت و تحت نظارت را ترکیب میکنند، پیشنهاد شدهاند.

در نتیجه، یادگیری بدون نظارت یک ابزار قدرتمند در زمینه سیستم های توصیه گر است.

این به الگوریتم ها اجازه می دهد تا الگوها و روابط را در داده ها بدون راهنمایی صریح کشف کنند که منجر به توصیه های دقیق تر و متنوع تر می شود.

با استفاده از تکنیکهایی مانند خوشهبندی و کاهش ابعاد، سیستمهای توصیهگر میتوانند پیشنهادات شخصیسازی شده را ارائه دهند و تجربه کاربر را افزایش دهند.

با این حال، چالش هایی مانند مشکل شروع سرد هنوز باید مورد توجه قرار گیرد تا به طور کامل از پتانسیل یادگیری بدون نظارت در سیستم های توصیه گر استفاده شود.

منبع » آکادمی اشکان مستوفی