Explainable AI که با نام XAI نیز شناخته می شود هوش مصنوعی (AI) به بخشی جدایی ناپذیر تبدیل شده است از زندگی ما، از دستیارهای صوتی مانند سیری و الکسا گرفته تا الگوریتم های توصیه در پلتفرم های رسانه های اجتماعی.

با این حال، با پیچیدهتر شدن هوش مصنوعی، نگرانیهایی در مورد فرآیندهای تصمیمگیری و سوگیریهای احتمالی آن به وجود آمده است.

اینجاست که هوش مصنوعی قابل توضیح (XAI) وارد عمل می شود.

هوش مصنوعی XAI

XAI به توانایی سیستم های هوش مصنوعی برای ارائه توضیحات قابل فهم برای تصمیمات خود اشاره دارد که به انسان اجازه می دهد تا فناوری را درک کرده و به آن اعتماد کند.

در تصمیم گیری اخلاقی، نمی توان اهمیت XAI را نادیده گرفت.

زمانی که سیستمهای هوش مصنوعی تصمیماتی میگیرند که بر افراد یا جامعه بهعنوان یک کل تأثیر میگذارد، درک چگونگی و چرایی این تصمیمها بسیار مهم است.

بدون شفافیت، هوش مصنوعی میتواند تعصبات را تداوم بخشد، علیه گروههای خاصی تبعیض قائل شود یا تصمیماتی بگیرد که توجیه آن دشوار است.

XAI این نگرانیها را با ارائه بینشهایی در مورد فرآیند تصمیمگیری برطرف میکند و شناسایی و اصلاح هرگونه سوگیری یا خطا را آسانتر میکند.

یکی از مزایای کلیدی XAI توانایی آن در افزایش مسئولیت پذیری است.

وقتی سیستمهای هوش مصنوعی شفاف و قابل توضیح باشند، راحتتر میتوان آنها را در قبال اقداماتشان پاسخگو دانست.

این امر به ویژه در بخش هایی مانند مراقبت های بهداشتی، مالی و عدالت کیفری، که در آن سیستم های هوش مصنوعی به طور فزاینده ای برای تصمیم گیری های حیاتی مورد استفاده قرار می گیرند، اهمیت دارد.

به عنوان مثال، در مراقبت های بهداشتی، از الگوریتم های هوش مصنوعی برای تشخیص بیماری ها و توصیه درمان استفاده می شود.

سیستمهای هوش مصنوعی با ارائه توضیحاتی برای تصمیمات خود، میتوانند به پزشکان و بیماران کمک کنند تا دلیل پشت تشخیص یا طرح درمانی خاص را درک کنند و اعتماد و پاسخگویی را افزایش دهند.

علاوه بر این، XAI می تواند به شناسایی و کاهش تعصبات در سیستم های هوش مصنوعی کمک کند.

الگوریتمهای هوش مصنوعی بر روی حجم وسیعی از دادهها آموزش میبینند، و اگر این دادهها بایاس باشند، الگوریتم آن سوگیریها را یاد میگیرد و تداوم میبخشد.

این میتواند منجر به نتایج تبعیضآمیز، مانند شیوههای استخدام جانبدارانه یا تأییدیههای وام ناعادلانه شود. XAI به ما این امکان را می دهد تا با ارائه بینش هایی در مورد فرآیند تصمیم گیری، این سوگیری ها را کشف کنیم.

با درک اینکه چگونه یک سیستم هوش مصنوعی به یک تصمیم خاص رسیده است، میتوانیم هرگونه سوگیری در دادهها یا الگوریتم اصلی را شناسایی و برطرف کنیم و از نتایج منصفانه و عادلانه اطمینان حاصل کنیم.

علاوه بر پاسخگویی و کاهش تعصب، XAI همچنین اعتماد کاربر و پذیرش سیستمهای هوش مصنوعی را ارتقا میدهد.

اعتماد برای پذیرش گسترده فناوری های هوش مصنوعی بسیار مهم است. اگر کاربران نتوانند تصمیمات اتخاذ شده توسط سیستم های هوش مصنوعی را درک کنند یا به آنها اعتماد کنند، احتمال کمتری دارد که آنها را بپذیرند.

XAI با ارائه توضیحاتی که برای انسان قابل درک است، این شکاف را پر می کند. هنگامی که کاربران می توانند استدلال پشت تصمیم یک سیستم هوش مصنوعی را درک کنند، به احتمال زیاد به آن اعتماد کرده و آن را می پذیرند.

با این حال، پیاده سازی XAI بدون چالش نیست. سیستمهای هوش مصنوعی اغلب پیچیده هستند و بر روی حجم وسیعی از دادهها کار میکنند و ارائه توضیحات ساده و مختصر را دشوار میکنند.

ایجاد تعادل بین نیاز به شفافیت و پیچیدگی الگوریتم های هوش مصنوعی کار ظریفی است.

محققان و توسعه دهندگان فعالانه روی توسعه تکنیک ها و ابزارهایی کار می کنند تا XAI را قابل دسترس تر و قابل درک تر کنند.

در نتیجه، هوش مصنوعی توضیح پذیر نقش مهمی در تصمیم گیری اخلاقی ایفا می کند. با ارائه توضیحات قابل فهم برای تصمیمات سیستم های هوش مصنوعی، XAI مسئولیت پذیری را افزایش می دهد، به شناسایی و کاهش سوگیری ها کمک می کند و اعتماد و پذیرش کاربر را ارتقا می دهد.

همانطور که هوش مصنوعی به پیشرفت خود ادامه می دهد و بیشتر در زندگی ما یکپارچه می شود، اهمیت XAI را نمی توان نادیده گرفت.

ضروری است اطمینان حاصل شود که سیستمهای هوش مصنوعی شفاف، قابل توضیح هستند و در نهایت در خدمت بهترین منافع افراد و جامعه به عنوان یک کل هستند.

درک اصول کلیدی هوش مصنوعی قابل توضیح

هوش مصنوعی قابل توضیح که به نام XAI نیز شناخته می شود، به توانایی سیستم های هوش مصنوعی برای ارائه توضیحات واضح و قابل فهم برای تصمیمات و اقدامات خود اشاره دارد.

هدف آن پر کردن شکاف بین ماهیت جعبه سیاه سیستم های هوش مصنوعی سنتی و نیاز به شفافیت و پاسخگویی است.

یکی از اصول کلیدی هوش مصنوعی قابل توضیح تفسیرپذیری است. تفسیرپذیری به توانایی درک و توضیح اینکه چگونه یک سیستم هوش مصنوعی به یک تصمیم یا پیشبینی خاص میرسد اشاره دارد.

این شامل ارائه بینشی در مورد عملکرد داخلی مدل هوش مصنوعی است، مانند ویژگی هایی که آن را مهم می داند و روابطی که بین آن ویژگی ها شناسایی می کند.

شفافیت یکی دیگر از اصول مهم هوش مصنوعی قابل توضیح است. شفافیت شامل باز و در دسترس بودن فرآیند تصمیم گیری سیستم های هوش مصنوعی برای کاربران است.

این به کاربران اجازه می دهد تا عوامل موثر بر تصمیمات سیستم هوش مصنوعی را درک کنند و قابلیت اطمینان و انصاف آن را ارزیابی کنند.

هوش مصنوعی قابل توضیح همچنین بر اهمیت انصاف و کاهش تعصب تأکید دارد.

سیستمهای هوش مصنوعی بر روی حجم وسیعی از دادهها آموزش میبینند، و اگر این دادهها مغرضانه باشند، سیستم هوش مصنوعی میتواند این سوگیریها را تداوم و تقویت کند.

هدف هوش مصنوعی قابل توضیح شناسایی و کاهش تعصبات در سیستمهای هوش مصنوعی، حصول اطمینان از اتخاذ تصمیمات منصفانه و بیطرفانه.

یکی دیگر از اصول هوش مصنوعی قابل توضیح، مسئولیت پذیری است. پاسخگویی به توانایی نسبت دادن مسئولیت تصمیمات اتخاذ شده توسط سیستم های هوش مصنوعی اشاره دارد.

این شامل ارائه توضیحات روشن برای تصمیمات اتخاذ شده توسط سیستم های هوش مصنوعی و اطمینان از همسویی آنها با استانداردهای اخلاقی و قانونی است.

برای دستیابی به این اصول، تکنیک ها و رویکردهای مختلفی در هوش مصنوعی قابل توضیح استفاده می شود.

یکی از این تکنیکها توضیحات مبتنی بر قانون است که در آن سیستمهای هوش مصنوعی بر اساس قوانین از پیش تعریفشده یا درختهای تصمیم، توضیحاتی را ارائه میدهند.

این قوانین را می توان به راحتی توسط انسان درک کرد و بینش هایی را در مورد فرآیند تصمیم گیری ارائه کرد.

رویکرد دیگر، توضیحات مدل-آگنوستیک است، که در آن سیستمهای هوش مصنوعی توضیحاتی را ارائه میدهند که مستقل از مدل اصلی هستند.

این به کاربران اجازه می دهد تا تصمیمات اتخاذ شده توسط سیستم های هوش مصنوعی را بدون نیاز به درک پیچیدگی های خود مدل درک کنند.

علاوه بر این، توضیحات پس از آن در هوش مصنوعی قابل توضیح استفاده می شود.

توضیحات پس از آن شامل تجزیه و تحلیل خروجی یک سیستم هوش مصنوعی و ارائه توضیحات بر اساس آن خروجی است.

این رویکرد به کاربران اجازه میدهد تا پس از تصمیمگیریهای سیستم هوش مصنوعی، استدلال پشت آن را درک کنند.

هوش مصنوعی قابل توضیح کاربردهای متعددی در حوزه های مختلف دارد. به عنوان مثال، در مراقبت های بهداشتی، می تواند به پزشکان کمک کند تا دلایل پشت تشخیص ها و توصیه های درمانی مبتنی بر هوش مصنوعی را درک کنند.

در امور مالی، می تواند توضیحاتی را برای تصمیمات امتیازدهی اعتباری یا توصیه های سرمایه گذاری ارائه دهد.

در نتیجه، هوش مصنوعی قابل توضیح جنبه حیاتی سیستم های هوش مصنوعی است که هدف آن ارائه توضیحات واضح و قابل درک برای تصمیمات و اقدامات آنها است.

بر تفسیرپذیری، شفافیت، انصاف و پاسخگویی تاکید دارد. با درک اصول کلیدی هوش مصنوعی قابل توضیح و تکنیک های مورد استفاده برای دستیابی به آنها، می توانیم اطمینان حاصل کنیم که سیستم های هوش مصنوعی نه تنها قدرتمند، بلکه قابل اعتماد و پاسخگو هستند.

کاوش در نقش شفافیت در سیستم های هوش مصنوعی قابل توضیح

به عبارت ساده، به توانایی یک سیستم هوش مصنوعی برای ارائه توضیحات قابل فهم برای تصمیمات یا پیش بینی های خود اشاره دارد.

مدلهای سنتی هوش مصنوعی، مانند شبکههای عصبی یادگیری عمیق، اغلب به عنوان «جعبههای سیاه» شناخته میشوند، زیرا بر اساس الگوهای پیچیده تصمیمگیری میکنند که تفسیر آن برای انسان دشوار است.

این عدم شفافیت می تواند مشکل ساز باشد، به ویژه در حوزه های حیاتی مانند مراقبت های بهداشتی یا مالی، که توانایی درک و اعتماد به تصمیمات هوش مصنوعی بسیار مهم است.

از سوی دیگر، سیستمهای هوش مصنوعی قابل توضیح، برای رسیدگی به این موضوع با ارائه توضیحاتی برای تصمیمات خود طراحی شدهاند.

این توضیحات می توانند اشکال مختلفی مانند توصیف متنی، تجسم یا حتی رابط های تعاملی داشته باشند. با شفافتر کردن فرآیند تصمیمگیری، سیستمهای XAI به کاربران این امکان را میدهند تا بفهمند چرا یک تصمیم خاص گرفته شده و قابلیت اطمینان و عادلانه بودن سیستم هوش مصنوعی را ارزیابی کنند.

شفافیت نقشی حیاتی در توسعه و استقرار سیستمهای هوش مصنوعی ایفا میکند.

این به ایجاد اعتماد بین کاربران و الگوریتمهای هوش مصنوعی کمک میکند، زیرا کاربران میتوانند استدلال پشت تصمیمهای گرفته شده توسط سیستم را تأیید کنند.

این امر به ویژه در برنامه های پرمخاطره، که در آن عواقب تصمیمات نادرست یا مغرضانه می تواند شدید باشد، بسیار مهم است.

برای مثال، در مراقبتهای بهداشتی، یک سیستم XAI میتواند توضیحاتی را برای تشخیصهای پزشکی به پزشکان ارائه دهد و به آنها اجازه دهد تا عوامل زمینهای را درک کنند و تصمیمات آگاهانهتری بگیرند.

علاوه بر این، شفافیت در سیستمهای هوش مصنوعی به شناسایی و کاهش تعصبات کمک میکند.

الگوریتمهای هوش مصنوعی بر روی حجم وسیعی از دادهها آموزش داده میشوند و اگر دادههای آموزشی مغرضانه باشد، سیستم هوش مصنوعی میتواند ناخواسته آن سوگیریها را یاد بگیرد و تداوم بخشد.

با ارائه توضیحات، سیستمهای XAI به کاربران اجازه میدهند تا این سوگیریها را شناسایی و برطرف کنند و از تصمیمگیری منصفانه و بیطرفانه اطمینان حاصل کنند.

با این حال، دستیابی به شفافیت در سیستم های هوش مصنوعی بدون چالش نیست.

یکی از چالش های اصلی ایجاد تعادل بین شفافیت و عملکرد است. همانطور که مدل های هوش مصنوعی پیچیده تر می شوند، ارائه توضیحات دقیق برای هر تصمیم می تواند از نظر محاسباتی گران باشد و ممکن است بر عملکرد کلی سیستم تأثیر بگذارد.

بنابراین، محققان و توسعه دهندگان باید راه هایی برای ارائه توضیحات معنادار بدون به خطر انداختن کارایی و دقت سیستم هوش مصنوعی بیابند.

چالش دیگر تفسیرپذیری مدل های هوش مصنوعی است.

در حالی که هدف سیستمهای XAI ارائه توضیحات است، خود مدلهای زیربنایی هوش مصنوعی ممکن است هنوز پیچیده و تفسیر آنها دشوار باشد.

این سؤالاتی را در مورد قابل فهم بودن توضیحات ارائه شده توسط سیستم های XAI ایجاد می کند.

اگر کاربران نتوانند توضیحات را درک کنند، شفافیت ارائه شده توسط سیستم های XAI کمتر موثر می شود.

در نتیجه، سیستمهای هوش مصنوعی قابل توضیح (XAI) برای رفع فقدان شفافیت و توضیحپذیری در مدلهای هوش مصنوعی سنتی طراحی شدهاند.

سیستم های XAI با ارائه توضیحات قابل درک برای تصمیمات خود، کاربران را قادر می سازند تا به استدلال پشت الگوریتم های هوش مصنوعی اعتماد کرده و آن را تأیید کنند.

شفافیت در سیستمهای هوش مصنوعی برای ایجاد اعتماد، شناسایی سوگیریها و اطمینان از تصمیمگیری منصفانه بسیار مهم است.

با این حال، دستیابی به شفافیت در سیستمهای هوش مصنوعی مجموعهای از چالشهای خاص خود را دارد، مانند ایجاد تعادل بین شفافیت و عملکرد و اطمینان از قابلیت تفسیر مدلهای هوش مصنوعی.

با این وجود، توسعه و استقرار سیستم های XAI برای استفاده مسئولانه و اخلاقی از هوش مصنوعی در حوزه های مختلف ضروری است.

برنامه های بالقوه and Limitations of Explainable AI

Explainable AI که با نام XAI نیز شناخته می شود، حوزه ای است که به سرعت در حال رشد در حوزه هوش مصنوعی است.

این به توانایی سیستم های هوش مصنوعی برای ارائه توضیحات واضح و قابل درک برای تصمیمات و اقدامات خود اشاره دارد.

این برخلاف سیستمهای هوش مصنوعی سنتی است که اغلب بهعنوان جعبه سیاه عمل میکنند و درک استدلال پشت خروجیهایشان را برای انسان دشوار میسازد.

یکی از کاربردهای بالقوه هوش مصنوعی قابل توضیح در صنعت مراقبت های بهداشتی نهفته است.

سناریویی را تصور کنید که در آن پزشک از یک سیستم هوش مصنوعی برای تشخیص بیماری بیمار استفاده می کند.

با هوش مصنوعی قابل توضیح، پزشک نه تنها میتواند تشخیص را دریافت کند، بلکه میتواند دلایل اساسی پشت آن را نیز درک کند.

این می تواند تا حد زیادی اعتماد پزشک را به سیستم هوش مصنوعی افزایش دهد و آنها را قادر می سازد تا تصمیمات آگاهانه تری در مورد درمان بیمار بگیرند.

هوش مصنوعی قابل توضیح در زمینه حقوقی نیز نویدبخش است.

در موارد پیچیده حقوقی، سیستمهای هوش مصنوعی میتوانند با تجزیه و تحلیل حجم وسیعی از دادهها و ارائه بینش به وکلا کمک کنند.

با این حال، درک دلیل پشت توصیه های سیستم هوش مصنوعی برای وکلا بسیار مهم است.

با استفاده از هوش مصنوعی قابل توضیح، وکلا می توانند درک عمیق تری از عواملی که بر نتیجه گیری سیستم هوش مصنوعی تأثیر گذاشته اند، به دست آورند و به آنها اجازه می دهد استدلال های قانع کننده تری را در دادگاه ارائه کنند.

یکی دیگر از کاربردهای بالقوه هوش مصنوعی قابل توضیح در بخش مالی است.

بانک ها و موسسات مالی اغلب برای تصمیم گیری در مورد تاییدیه های وام، استراتژی های سرمایه گذاری و ارزیابی ریسک به سیستم های هوش مصنوعی متکی هستند.

با این حال، این تصمیمات می تواند تأثیرات قابل توجهی بر افراد و مشاغل داشته باشد. با هوش مصنوعی قابل توضیح، مشتریان می توانند درک روشن تری از دلیل رد درخواست وام آنها یا اینکه چرا یک فرصت سرمایه گذاری خاص بسیار پرخطر تلقی می شود، داشته باشند.

این شفافیت می تواند به ایجاد اعتماد بین مشتریان و موسسات مالی کمک کند.

علیرغم پتانسیلی که دارد، هوش مصنوعی قابل توضیح محدودیت هایی دارد.

یکی از چالش ها ایجاد تعادل بین شفافیت و دقت است. همانطور که سیستم های هوش مصنوعی پیچیده تر می شوند، توضیحات ارائه شده ممکن است همیشه برای انسان به راحتی قابل درک نباشد.

ساده کردن بیش از حد توضیحات می تواند منجر به از دست دادن دقت شود، در حالی که ارائه توضیحات بسیار فنی ممکن است برای افراد غیر متخصص قابل درک نباشد. یافتن سطح مناسب توضیح کار ظریفی است که نیازمند تحقیق و توسعه بیشتر است.

محدودیت دیگر، پتانسیل سوگیری در سیستم های هوش مصنوعی است. اگر داده های آموزشی مورد استفاده برای توسعه سیستم هوش مصنوعی مغرضانه باشد، توضیحات ارائه شده نیز ممکن است سوگیری باشد.

این می تواند منجر به نتایج ناعادلانه یا تبعیض آمیز شود. پرداختن به این موضوع مستلزم توجه دقیق به داده های مورد استفاده برای آموزش و نظارت مداوم است تا اطمینان حاصل شود که سیستم هوش مصنوعی بی طرف باقی می ماند.

در نتیجه، هوش مصنوعی قابل توضیح با ارائه توضیحات واضح و قابل درک برای تصمیمات و اقدامات سیستم های هوش مصنوعی، پتانسیل ایجاد انقلابی در صنایع مختلف را دارد.

کاربردهای آن در مراقبتهای بهداشتی، حقوقی و مالی میتواند فرآیندهای تصمیمگیری را تا حد زیادی بهبود بخشد و بین انسانها و سیستمهای هوش مصنوعی اعتماد ایجاد کند.

با این حال، اذعان به محدودیتهای هوش مصنوعی قابل توضیح، مانند چالش ایجاد تعادل بین شفافیت و دقت، و همچنین پتانسیل برای سوگیری، مهم است.

ادامه تحقیق و توسعه در این زمینه برای غلبه بر این محدودیت ها و باز کردن کامل پتانسیل هوش مصنوعی قابل توضیح ضروری است. چالشها و مسیرهای آینده هوش مصنوعی توضیحپذیر

هوش مصنوعی توضیحپذیر، که به نام XAI نیز شناخته میشود، زمینهای به سرعت در حال رشد در هوش مصنوعی است که هدف آن رسیدگی به چالشهای درک و تفسیر تصمیمهای اتخاذ شده توسط سیستمهای هوش مصنوعی است.

از آنجایی که هوش مصنوعی در زندگی روزمره ما رواج بیشتری می یابد، داشتن درک روشنی از نحوه رسیدن این سیستم ها به نتایج خود بسیار مهم است.

این مقاله چالش های پیش روی XAI را بررسی می کند و مسیرهای آینده این حوزه هیجان انگیز را مورد بحث قرار می دهد.

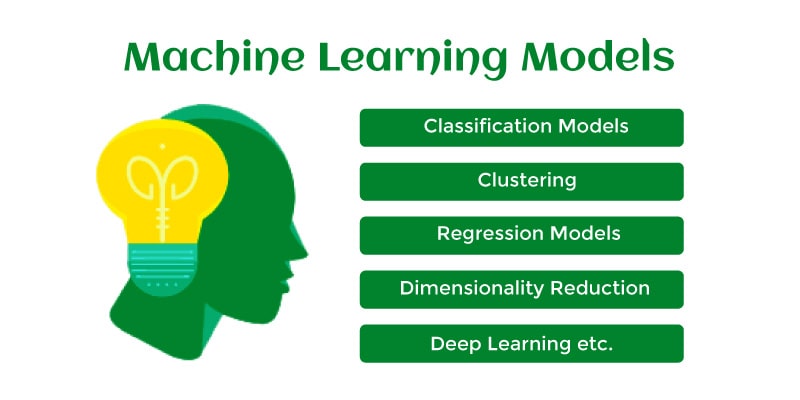

یکی از چالش های اصلی XAI پیچیدگی ذاتی مدل های هوش مصنوعی است.

به عنوان مثال، الگوریتم های یادگیری عمیق اغلب به عنوان “جعبه سیاه” شناخته می شوند زیرا تفسیر آنها دشوار است.

این مدلها از لایههای متعددی از گرههای به هم پیوسته تشکیل شدهاند که درک نحوه رسیدن آنها به تصمیمهایشان را دشوار میسازد.

این عدم شفافیت نگرانی هایی را در مورد قابلیت اطمینان و قابل اعتماد بودن سیستم های هوش مصنوعی ایجاد می کند.

برای مقابله با این چالش، محققان در زمینه XAI در حال توسعه تکنیکهایی هستند تا مدلهای هوش مصنوعی را قابل تفسیرتر کنند.

یک رویکرد استفاده از مدلهای سادهتر است که درک آن آسانتر است، مانند درختهای تصمیم یا سیستمهای مبتنی بر قانون. این مدلها مجموعهای واضح از قوانین را ارائه میکنند که میتوان از آنها برای درک چگونگی تصمیمگیری پیروی کرد.

با این حال، آنها ممکن است برخی از دقت را در مقایسه با مدل های پیچیده تر قربانی کنند.

رویکرد دیگر توسعه روش هایی است که بتواند تصمیمات اتخاذ شده توسط مدل های پیچیده هوش مصنوعی را توضیح دهد.

هدف این روش ها ارائه بینشی در مورد عملکرد داخلی مدل است که به کاربران امکان می دهد عواملی را که بر یک تصمیم خاص تأثیر می گذارد درک کنند.

تکنیکهایی مانند تجزیه و تحلیل اهمیت ویژگی و مکانیسمهای توجه میتوانند به شناسایی تأثیرگذارترین ویژگیها یا بخشهایی از ورودی کمک کنند که در تصمیمگیری نقش داشته است.

علاوه بر پیچیدگی مدلهای هوش مصنوعی، یکی دیگر از چالشهای XAI نیاز به ایجاد تعادل بین شفافیت با حفظ حریم خصوصی و نگرانیهای امنیتی است.

در حالی که درک نحوه تصمیم گیری سیستم های هوش مصنوعی مهم است، مواردی وجود دارد که افشای اطلاعات بیش از حد می تواند حریم خصوصی را به خطر بیاندازد یا عوامل مخرب را قادر به سوء استفاده از آسیب پذیری ها کند.

ایجاد تعادل مناسب بین شفافیت و حفاظت از جنبه های حیاتی تحقیقات XAI است.

جهتهای آینده XAI امیدوارکننده است. محققان در حال بررسی تکنیکهای جدید برای بهبود تفسیرپذیری مدلهای هوش مصنوعی بدون کاهش دقت هستند.

یکی از حوزههای تمرکز، توسعه مدلهای ترکیبی است که نقاط قوت مدلهای پیچیده را با قابلیت تفسیر مدلهای سادهتر ترکیب میکند. هدف این مدل های ترکیبی ارائه پیش بینی های دقیق و توضیحات قابل درک است.

جهت دیگر ادغام بازخورد انسانی در فرآیند تصمیم گیری هوش مصنوعی است. با درگیر کردن انسان ها در حلقه، سیستم های XAI می توانند از تخصص انسانی برای اعتبارسنجی و اصلاح تصمیمات اتخاذ شده توسط مدل های هوش مصنوعی استفاده کنند.

این همکاری انسان و هوش مصنوعی می تواند به سیستم های هوش مصنوعی قابل اعتمادتر و قابل اعتمادتر منجر شود.

علاوه بر این، تلاش هایی برای استانداردسازی ارزیابی تکنیک های XAI در حال انجام است.

در حال حاضر، هیچ چارچوب قابل قبولی برای ارزیابی قابلیت تفسیر مدلهای هوش مصنوعی وجود ندارد.

توسعه معیارها و معیارهای ارزیابی استاندارد، محققان را قادر می سازد تا روش های مختلف XAI را به طور موثر مقایسه و بهبود بخشند.

در نتیجه، هوش مصنوعی قابل توضیح، زمینه ای است که به چالش های درک و تفسیر تصمیمات اتخاذ شده توسط سیستم های هوش مصنوعی می پردازد.

پیچیدگی مدل های هوش مصنوعی و نیاز به ایجاد تعادل بین شفافیت با حفظ حریم خصوصی و نگرانی های امنیتی از جمله چالش های اصلی XAI است.

با این حال، جهتگیریهای آینده این زمینه امیدوارکننده است، با تحقیقات در حال انجام که بر توسعه مدلهای قابل تفسیرتر، یکپارچهسازی بازخورد انسانی و استانداردسازی معیارهای ارزیابی تمرکز دارد.

همانطور که XAI به تکامل خود ادامه می دهد، نقش مهمی در تضمین شفافیت و قابل اعتماد بودن سیستم های هوش مصنوعی در حوزه های مختلف خواهد داشت.

منبع » آکادمی اشکان مستوفی