سال های اخیر همانطور که الگوریتم های یادگیری ماشین در زندگی روزمره ما رایج تر می شوند، پرداختن به موضوع سوگیری در جمع آوری داده ها برای این مدل ها بسیار مهم است.

سوگیری میتواند در مراحل مختلف فرآیند یادگیری ماشین رخ دهد، اما تمرکز بر جمعآوری دادهها اهمیت ویژهای دارد، زیرا در اینجاست که میتوان بهطور ناخواسته سوگیریها را معرفی کرد.

سوگیری چیست؟

جمع آوری داده ها پایه و اساس هر مدل یادگیری ماشینی است.

کیفیت و نمایندگی داده های مورد استفاده برای آموزش این مدل ها به طور مستقیم بر عملکرد و عدالت آنها تأثیر می گذارد.

با این حال، سوگیریها میتوانند به راحتی وارد فرآیند جمعآوری دادهها شوند و به مدلهای مغرضانه منجر شوند که نابرابریهای اجتماعی موجود را تداوم میبخشند.

یکی از منابع رایج سوگیری در جمع آوری داده ها، سوگیری انتخاب است.

سوگیری انتخاب

این زمانی اتفاق میافتد که دادههای مورد استفاده برای آموزش مدل، نماینده جمعیتی نباشد که در نظر گرفته شده است.

به عنوان مثال، اگر یک سیستم تشخیص چهره با استفاده از چهرههای عمدتاً سفید رنگ آموزش داده شود، ممکن است برای شناسایی دقیق افرادی با رنگ پوست تیرهتر مشکل داشته باشد.

این می تواند عواقب جدی مانند شناسایی نادرست و نتایج تبعیض آمیز داشته باشد.

برای رسیدگی به سوگیری انتخاب، بسیار مهم است که اطمینان حاصل شود که داده های آموزشی متنوع و معرف جمعیت هستند.

این را می توان با جمع آوری داده ها از طیف گسترده ای از منابع و جمعیت شناسی به دست آورد.

علاوه بر این، ارزیابی و به روز رسانی منظم داده های آموزشی برای محاسبه هرگونه تغییر در جمعیت یا هنجارهای اجتماعی مهم است.

شکل دیگری از سوگیری که می تواند در جمع آوری داده ها ایجاد شود سوگیری نمونه گیری است.

سوگیری نمونه گیری

این زمانی اتفاق میافتد که دادههای جمعآوریشده یک نمونه تصادفی از جامعه نباشد، که منجر به نتایج ناهموار میشود.

به عنوان مثال، اگر یک الگوریتم مراقبت های بهداشتی با استفاده از داده های یک بیمارستان خاص آموزش داده شود، ممکن است به خوبی به سایر تنظیمات مراقبت های بهداشتی تعمیم نیابد.

این می تواند منجر به توصیه ها یا درمان های مغرضانه برای گروه های خاصی از بیماران شود.

برای کاهش سوگیری نمونه گیری، طراحی دقیق فرآیند جمع آوری داده ها ضروری است.

برای اطمینان از اینکه داده های جمع آوری شده معرف جامعه هستند، می توان از تکنیک های نمونه گیری تصادفی استفاده کرد.

علاوه بر این، در نظر گرفتن زمینهای که دادهها در آن جمعآوری میشوند و اینکه آیا هرگونه سوگیری ممکن است در نتیجه معرفی شود، مهم است.

علاوه بر سوگیری انتخاب و نمونه گیری، اشکال دیگری از سوگیری وجود دارد که می تواند در جمع آوری داده ها آشکار شود.

سوگیری تایید

برای مثال، سوگیری تایید زمانی اتفاق میافتد که دادههای جمعآوریشده به سمت تایید باورها یا فرضیههای از پیش موجود سوگیری داشته باشند.

این می تواند منجر به تقویت سوگیری های موجود شود و مانع از کشف بینش های جدید شود.

برای مقابله با سوگیری تایید، مهم است که با ذهنی باز به جمع آوری داده ها نزدیک شوید و از داده های گیلاسی که از تصورات قبلی پشتیبانی می کنند اجتناب کنید.

علاوه بر این، درگیر کردن دیدگاههای مختلف در فرآیند جمعآوری دادهها میتواند به شناسایی و به چالش کشیدن هرگونه سوگیری که ممکن است ایجاد شود کمک کند.

در نتیجه، پرداختن به سوگیری در جمع آوری داده ها برای توسعه مدل های یادگیری ماشینی منصفانه و بی طرفانه بسیار مهم است.

سوگیری انتخاب، سوگیری نمونه گیری و سوگیری تایید تنها چند نمونه از سوگیری هایی هستند که می توانند در فرآیند جمع آوری داده ها ایجاد شوند.

با اطمینان از اینکه دادههای آموزشی متنوع، معرف و عاری از تعصب هستند، میتوانیم مدلهای یادگیری ماشینی ایجاد کنیم که منصفانه و منصفانه باشند.

ارزیابی و به روز رسانی مداوم فرآیند جمع آوری داده ها برای محاسبه هرگونه تغییر در جمعیت یا هنجارهای اجتماعی ضروری است.

تنها با پرداختن به سوگیری در جمعآوری دادهها، میتوانیم مدلهای یادگیری ماشینی بسازیم که واقعاً نیازهای همه افراد را برآورده کند.

ملاحظات اخلاقی در کاهش سوگیری در یادگیری ماشینی

یکی از دلایل اصلی نگرانی بایاس در یادگیری ماشینی این است که این الگوریتمها بر اساس دادههای تاریخی آموزش داده میشوند که ممکن است دارای سوگیریهای ذاتی باشند.

به عنوان مثال، اگر یک الگوریتم یادگیری ماشینی بر روی دادههایی که عمدتاً مرد هستند آموزش ببیند، ممکن است به طور ناخواسته یاد بگیرد که ویژگیهای خاصی را با مرد بودن مرتبط کند.

این می تواند منجر به نتایج مغرضانه شود، مانند تبعیض جنسیتی در فرآیندهای استخدام یا تاییدیه وام.

برای پرداختن به این موضوع، محققان و پزشکان تکنیکهای مختلفی را برای کاهش تعصب در یادگیری ماشین پیشنهاد کردهاند.

یک رویکرد این است که داده های آموزشی را به دقت تنظیم کنید تا اطمینان حاصل شود که نماینده جمعیت است.

این شامل جمعآوری دادهها از منابع مختلف و برداشتن گامهایی برای حذف هرگونه سوگیری که ممکن است در دادهها وجود داشته باشد، است.

به عنوان مثال، اگر یک مجموعه داده حاوی نقاط داده بیشتری برای یک جنسیت در مقایسه با جنسیت دیگر باشد، محققان می توانند با نمونه برداری بیش از حد از جنسیت کم ارائه شده، مجموعه داده را متعادل کنند.

یکی دیگر از تکنیکهای کاهش تعصب در یادگیری ماشین، استفاده از الگوریتمهای آگاه از انصاف است.

این الگوریتمها به گونهای طراحی شدهاند که صراحتاً انصاف را به عنوان یک معیار در هنگام پیشبینی در نظر بگیرند.

برای مثال، یک الگوریتم آگاه از انصاف ممکن است با هدف به حداقل رساندن اختلاف در نتایج بین گروههای مختلف جمعیتی باشد.

این را می توان با تنظیم وزن های اختصاص داده شده به ویژگی های مختلف در الگوریتم یا با معرفی محدودیت های اضافی در طول فرآیند آموزش به دست آورد.

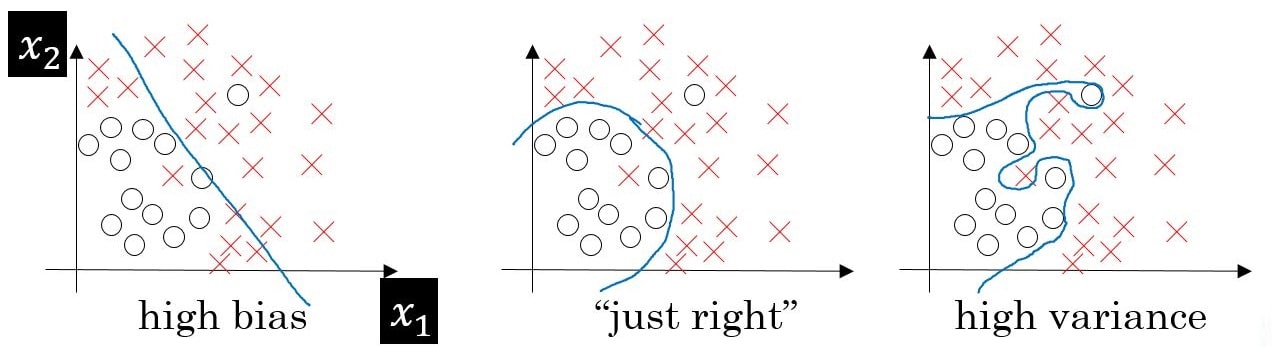

با این حال، کاهش تعصب در یادگیری ماشین بدون چالش نیست. یکی از چالشهای اصلی، تعریف عدالت است.

ذینفعان مختلف ممکن است دیدگاههای متفاوتی در مورد آنچه منصفانه است داشته باشند، و هیچ تعریف مورد توافق جهانی از انصاف وجود ندارد.

این امر طراحی الگوریتم هایی را که تصور همگان از انصاف را برآورده می کند دشوار می کند.

علاوه بر این، حتی اگر از یک الگوریتم آگاه از انصاف استفاده شود، اگر دادههای زیربنایی مغرضانه باشند، ممکن است همچنان نتایج مغرضانه ایجاد کند.

برای مثال، اگر یک مجموعه داده حاوی برچسبهای بایاس باشد یا اگر گروههای خاصی در دادهها نشان داده نمیشوند، الگوریتم ممکن است ناخواسته این سوگیریها را تداوم بخشد.

بنابراین، پرداختن به سوگیری در سطح داده نیز بسیار مهم است. چالش دیگر عدم شفافیت در الگوریتم های یادگیری ماشینی است.

بسیاری از مدلهای یادگیری ماشین «جعبههای سیاه» در نظر گرفته میشوند، به این معنی که درک نحوه رسیدن آنها به پیشبینیهایشان دشوار است.

این عدم شفافیت، شناسایی و رسیدگی به سوگیری ها در این الگوریتم ها را چالش برانگیز می کند.

محققان و پزشکان فعالانه روی توسعه تکنیکهایی کار میکنند تا الگوریتمهای یادگیری ماشین را قابل تفسیر و توضیحتر کنند.

در نتیجه، سوگیری در یادگیری ماشین یک موضوع پیچیده و چند وجهی است.

در حالی که تکنیکهایی برای کاهش تعصب وجود دارد، چالشهایی مانند تعریف انصاف و پرداختن به سوگیریها در سطح دادهها همچنان وجود دارد.

برای محققان، پزشکان و سیاستگذاران بسیار مهم است که برای توسعه دستورالعملهای اخلاقی و بهترین شیوهها برای کاهش تعصب در یادگیری ماشین با یکدیگر همکاری کنند.

با انجام این کار، میتوانیم مطمئن شویم که الگوریتمهای یادگیری ماشین منصفانه، شفاف و پاسخگو هستند.

استراتژیهایی برای تشخیص و کاهش تعصب در مدلهای یادگیری ماشینی

سوگیری در یادگیری ماشینی به رفتار ناعادلانه یا تبعیض آمیز با گروه ها یا افراد خاص بر اساس ویژگی ها یا ویژگی های آنها اشاره دارد.

این سوگیری میتواند ناخواسته باشد، اما همچنان میتواند تاثیرات قابلتوجهی بر زندگی مردم داشته باشد.

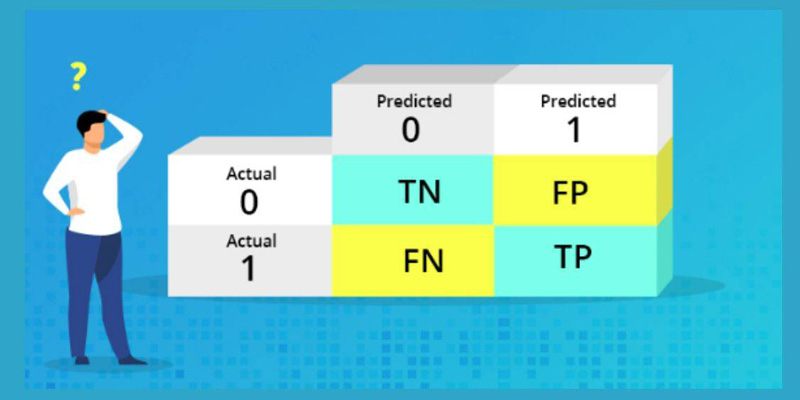

یکی از چالشهای اصلی در تشخیص سوگیری در مدلهای یادگیری ماشین این است که شناسایی آن میتواند ظریف و دشوار باشد.

با این حال، چندین استراتژی وجود دارد که می تواند به شناسایی و کاهش سوگیری در این مدل ها کمک کند.

یکی از این استراتژی ها بررسی دقیق داده های مورد استفاده برای آموزش الگوریتم یادگیری ماشین است.

ضروری است اطمینان حاصل شود که داده ها معرف جمعیتی است که هدف آن ارائه خدمات است.

اگر دادهها به سمت گروههای خاصی سوگیری یا انحراف داشته باشند، مدل حاصل نیز سوگیری خواهد داشت.

استراتژی دیگر انجام تجزیه و تحلیل کامل از ویژگی ها یا متغیرهای مورد استفاده در مدل یادگیری ماشینی است.

ارزیابی اینکه آیا این ویژگی ها برای کار مورد نظر مرتبط و ضروری هستند یا خیر، مهم است.

گاهی اوقات، برخی از ویژگی ها ممکن است به طور ناخواسته سوگیری را وارد مدل کنند.

با انتخاب دقیق و ارزیابی ویژگی ها، می توان احتمال سوگیری را کاهش داد.

علاوه بر این، درگیر کردن دیدگاهها و تخصصهای مختلف هنگام توسعه و ارزیابی مدلهای یادگیری ماشین بسیار مهم است.

با گنجاندن افراد با پیشینه ها و تجربیات مختلف، احتمال بیشتری وجود دارد که سوگیری های احتمالی شناسایی و به آنها رسیدگی شود.

این را می توان از طریق همکاری های بین رشته ای یا با جستجوی ورودی از افرادی که در مورد حوزه یا جمعیت خاص مورد مطالعه آگاه هستند، انجام داد.

نظارت و ارزیابی منظم عملکرد مدلهای یادگیری ماشینی یکی دیگر از استراتژیهای مؤثر برای شناسایی و کاهش سوگیری است.

با ارزیابی مستمر پیشبینیها و نتایج مدل، امکان شناسایی هر گونه الگوی سوگیری که ممکن است پدیدار شود، وجود دارد.

این را می توان با مقایسه پیش بینی های مدل با نتایج دنیای واقعی یا با انجام ممیزی در فرآیند تصمیم گیری مدل انجام داد.

علاوه بر این استراتژیها، شفافیت و پاسخگویی در هنگام استفاده از مدلهای یادگیری ماشین بسیار مهم است.

این به معنای مستندسازی واضح تصمیمات و فرآیندهای مربوط به توسعه و استقرار مدل ها است.

با ارائه توضیحاتی برای پیش بینی ها و نتایج مدل، شناسایی و رسیدگی به هرگونه سوگیری که ممکن است ایجاد شود آسان تر می شود.

شایان ذکر است که اگرچه این استراتژیها میتوانند به شناسایی و کاهش تعصب در مدلهای یادگیری ماشین کمک کنند، اما بیخطا نیستند.

تعصب موضوعی پیچیده و چندوجهی است که نیازمند توجه و تلاش مداوم است.

یادگیری و سازگاری مداوم با ظهور بینش ها و تکنیک های جدید بسیار مهم است.

در نتیجه، سوگیری در یادگیری ماشین نگرانی مهمی است که باید به آن پرداخته شود.

با اجرای استراتژی هایی مانند بررسی دقیق داده ها، تجزیه و تحلیل ویژگی ها، شامل دیدگاه های متنوع، نظارت بر عملکرد، و شفاف و پاسخگو بودن، می توان سوگیری را در مدل های یادگیری ماشین شناسایی و کاهش داد.

با این حال، مهم است که بدانیم سوگیری یک موضوع پیچیده است که نیاز به هوشیاری و تلاش مداوم دارد.

با تلاش فعالانه برای کاهش تعصب، میتوانیم اطمینان حاصل کنیم که الگوریتمهای یادگیری ماشین برای همه منصفانه و منصفانه هستند.

منبع » آکادمی اشکان مستوفی